TL;DR

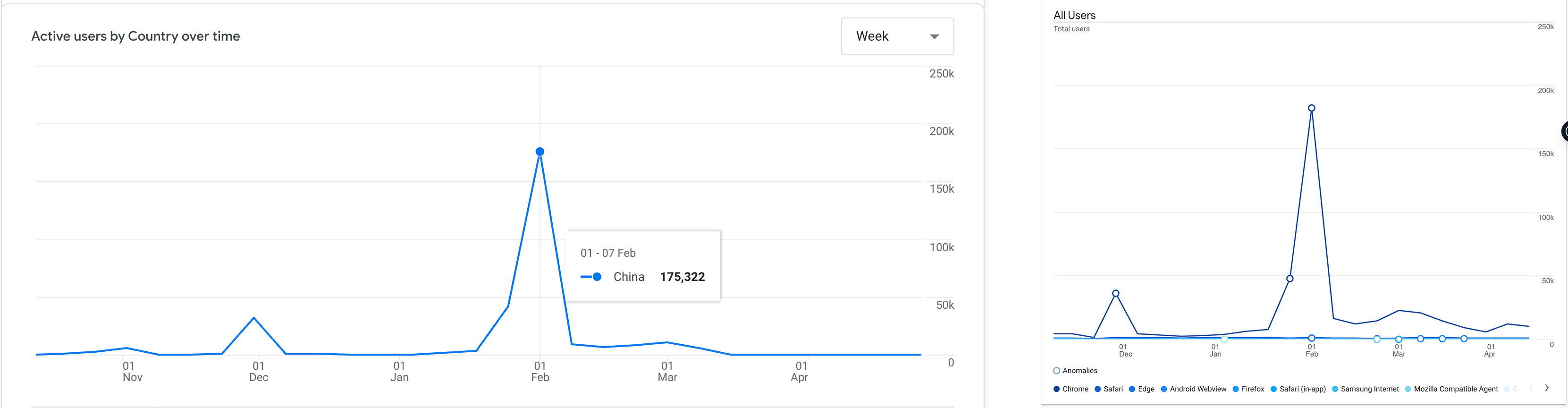

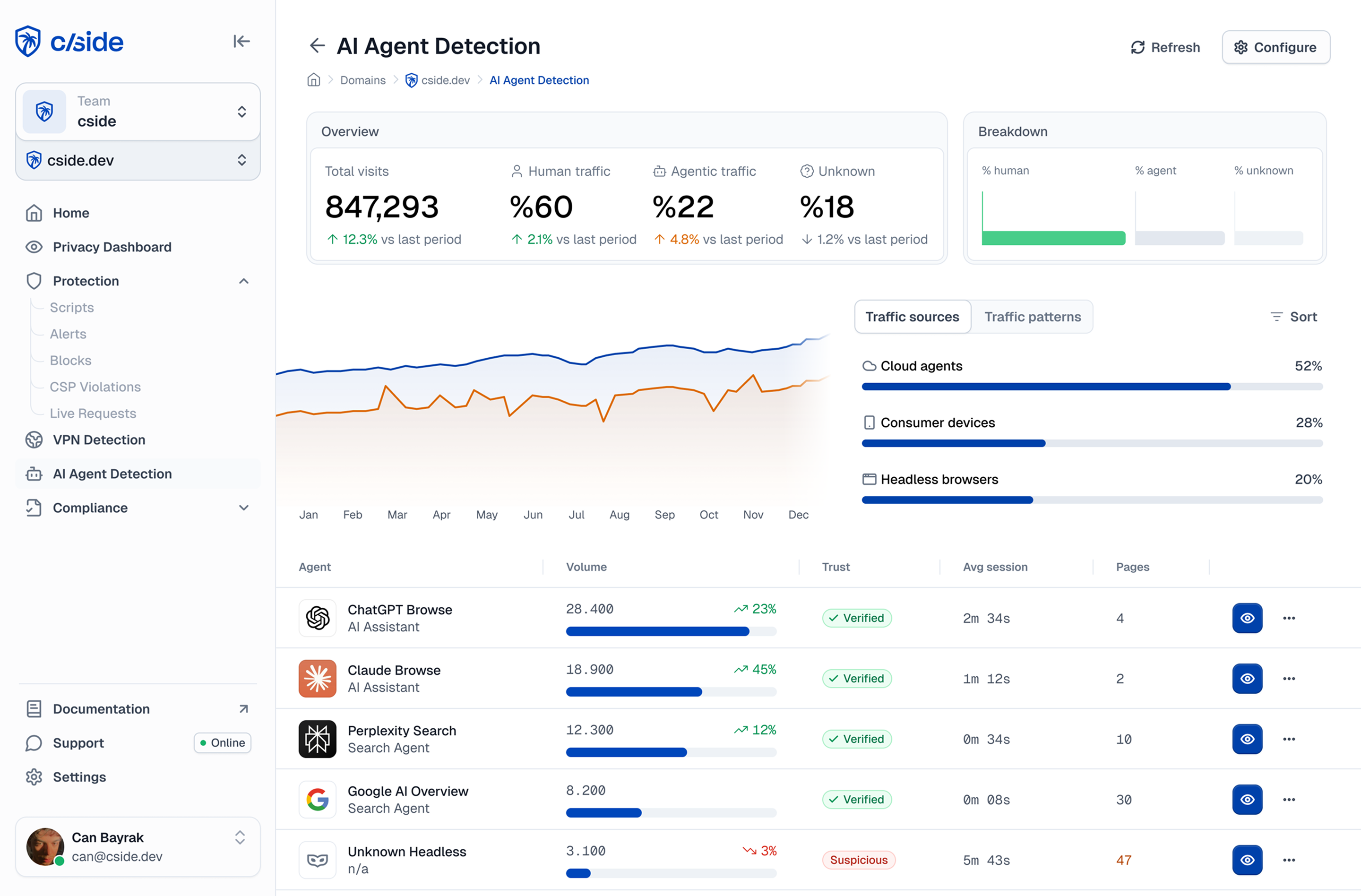

- Veelgebruikte methoden om AI-agentverkeer te identificeren zijn: serverlogs analyseren, traditionele botdetectietools (bijv. Cloudflare of Akamai), of gespecialiseerde AI-agentdetectietools zoals cside.

- Gespecialiseerde AI-agentdetectietools kijken naar vier categorieën signalen: identiteit, netwerk, browser en gedrag.

- Website-analysetools zoals Google Analytics of PostHog missen AI-agentverkeer doorgaans volledig of classificeren deze bezoekers ten onrechte als echte mensen.

- Crawler-gerelateerde AI-agents zijn makkelijker te identificeren (met doe-het-zelfmethoden of gratis tools), maar het opvangen van 'anti-detect' agents die gebouwd zijn voor frauduleuze doeleinden vereist een totaal andere toolkit.

- 81% van de interne tests van cside slaagden erin botdetectie van legacy-platforms te omzeilen met op AI-agents gebaseerde bots.

3 methoden om AI-agents op je website te detecteren

Samenvattende tabel: AI-agentverkeer op je website detecteren

| Serverlogs | Gespecialiseerde AI-agentdetectie | Traditionele botdetectie | Analysetools | |

|---|---|---|---|---|

| Wat het vangt | Bekende crawlers die zichzelf identificeren (GPTBot, ClaudeBot, etc.) | Stealth agents, browsergebaseerde bots, lokaal gehoste agents, frauduleuze automatisering | Gescripte bots, bekende kwaadaardige IP's, basis rate-abuse | Verkeeranomalieën en patronen die op botactiviteit wijzen |

| Beveiligingsdiepte | Mist agents die hun User-Agent spoofen of zichzelf niet declareren | Geen 100% perfecte dekking, maar de sterkste optie in het huidige landschap | Stealth browsers, residentiële proxy's, lokaal gehoste agents | Kan AI-agentsessies niet onderscheiden van menselijke sessies |

| Hoe in te stellen | Controleer je CDN-dashboard (Cloudflare, Vercel) of parse Nginx/Apache-accesslogs | Voeg een JS-snippet toe aan je site (vergelijkbaar met het installeren van analytics) | Schakel botbeveiliging in via je CDN-dashboard; enterprise-tiers vereisen contracten | Configureer aangepaste dimensies in GA4 of PostHog om anomalieën op te sporen |

| Kosten | Gratis | cside heeft Free, Small Business en Enterprise plannen | Gratis (basis) tot enterprise-prijzen | Gratis |

| Het beste voor | Snel eerste overzicht van bekende crawleractiviteit | Het opvangen van frauduleuze agents | Blokkeren van standaard bots en bekende kwaadaardige patronen | Ontdekken dat er iets mis is voordat je weet wat het is |

We bespreken specifieke signalen om op te letten op de netwerk-, browser- en gedragslagen verderop in deze blog.

Methode 1: Serverlogs analyseren

- Hoe het werkt: Elke keer dat iemand (inclusief bots) je website bezoekt, schrijft je server op wat het beweerde te zijn. Veel AI-bots vertellen je daadwerkelijk hun naam. De bot van OpenAI zegt "GPTBot," die van Anthropic zegt "ClaudeBot,". Om te bevestigen dat een crawler legitiem is en niet gespooft, verifieer je het IP-adres van het verzoek met de officieel gepubliceerde IP-bereiken van de crawler.

- Hoe in te stellen: Als je een CDN of hostingplatform gebruikt, controleer dan eerst hun dashboards. Cloudflare, Vercel en Netlify zitten al bovenop je serverlogs en presenteren deze informatie in een dashboard. Voor self-hosted sites bewaren je webservers (Nginx, Apache) accesslogs die je kunt downloaden of doorzoeken met commandoregeltools.

- Beperkingen: Dit werkt alleen bij bots die ervoor kiezen eerlijk te zijn. Zowel User-Agent strings als op IP-bereik gebaseerde verdedigingen kunnen eenvoudig omzeild worden. De bots die daadwerkelijk gevaarlijk zijn kondigen zichzelf niet aan. En browsergebaseerde agents zoals ChatGPT's Atlas of OpenClaw identificeren zichzelf minder snel via User-Agent strings.

Methode 2: Gespecialiseerde AI-agentdetectietools

Er is een nieuwe categorie detectietools ontstaan specifiek om AI-agents aan te pakken, omdat het probleem veel verder gaat dan scraping en crawling. 78% van de CTO's bij financiële instellingen ondervraagd door Accenture verwacht een toename van fraude gedreven door AI-shoppingagents.

- Hoe het werkt: Deze tools monitoren tientallen signalen over 4 detectielagen: identiteit (wie de bezoeker beweert te zijn), netwerk (waar ze vandaan verbinden), browseromgeving (hoe hun runtime eruitziet) en gedrag (hoe ze daadwerkelijk met de pagina interacteren). Door signalen over alle vier de lagen te kruisverwijzen, kunnen ze agents opvangen die elke individuele controle op zichzelf zouden doorstaan.

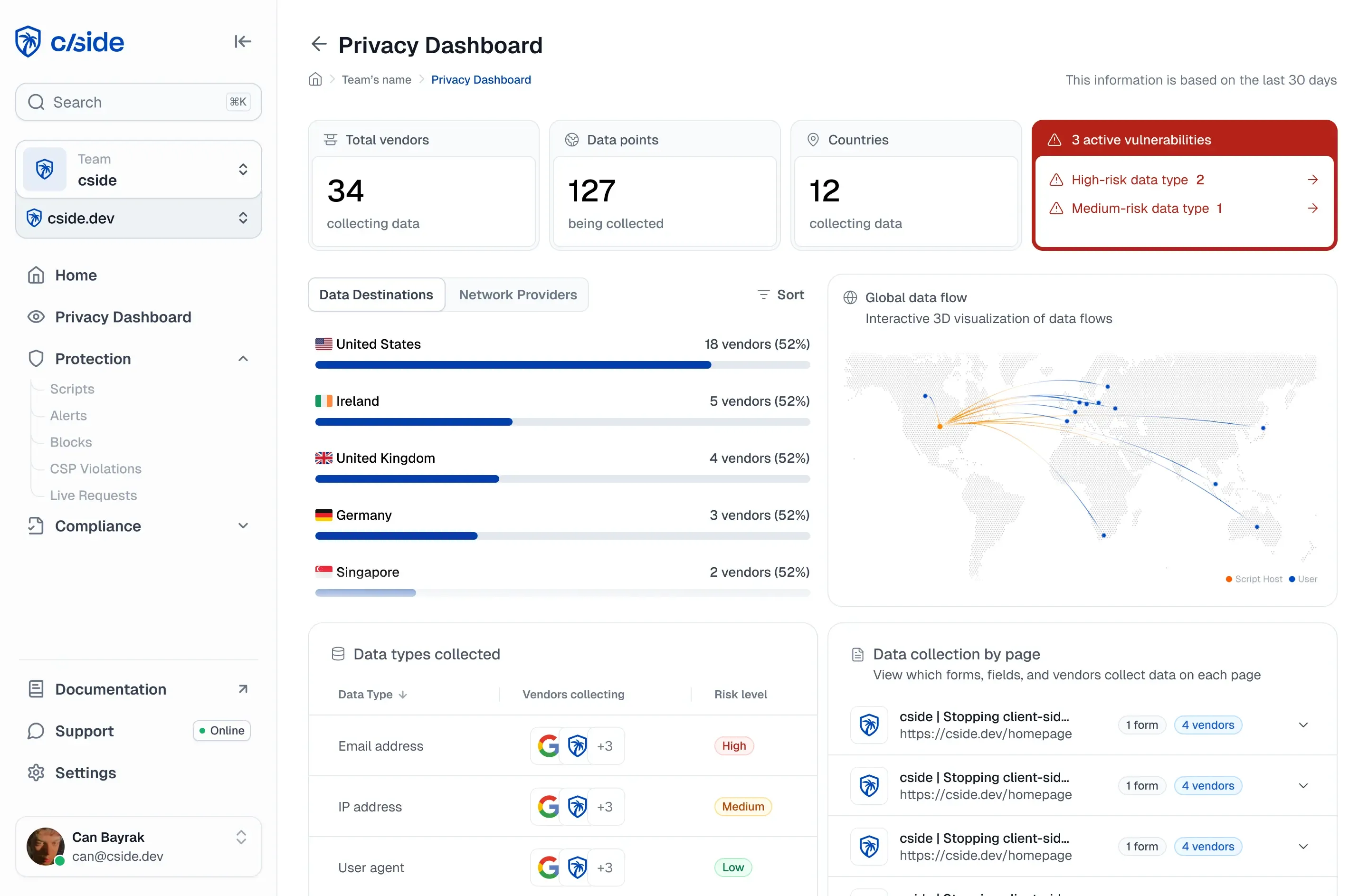

- Hoe in te stellen: De meeste van deze tools (zoals cside) worden geïnstalleerd door een JavaScript-snippet aan je site toe te voegen, vergelijkbaar met hoe je een analysetool zou installeren. Zodra cside geïnstalleerd is, monitort het direct activiteit over alle vier de signaallagen en toont het je een dashboard met welke bezoekers menselijk zijn, welke bekende agents zijn en welke verdacht zijn.

We bespreken de signalen die we gebruiken voor onze eigen AI-agentdetectie verderop in deze blog.

Methode 3: Traditionele botdetectietools

Tools zoals Cloudflare Bot Fight Mode en Akamai Bot Manager zijn gebouwd om geautomatiseerd verkeer op te vangen. Ze zijn het meest gebruikelijke startpunt voor botverdediging, en een die veel teams al hebben.

- Hoe ze werken: Deze tools analyseren binnenkomende verzoeken met een combinatie van IP-reputatie, TLS-fingerprints (JA3/JA4), headerconsistentie en challenge-response-mechanismen zoals CAPTCHAs.

- Hoe in te stellen: De meeste CDN-providers bieden een basis botbeveiligingsschakelaar in hun dashboard. Andere dedicated platforms vereisen mogelijk een JS-snippet of reverse proxy-setup, plus een contractgesprek.

Beperkingen: Veel beveiligingsleveranciers hebben het afgelopen jaar "AI-botdetectie" op hun productpagina's geplakt zonder de werking van hun detectie onder de motorkap adequaat te veranderen. Goedkope of gratis "add-ons" voor AI-agentdetectie vertrouwen grotendeels op het zoeken naar basisautomatiseringspatronen of CAPTCHA-achtige controles, en missen veel van de kwaadaardige agents.

Enkele van onze engineers bij cside voerden een test uit door op AI-agents gebaseerde bots in te zetten tegen twee grote botdetectieplatforms, en we omzeilden detectie bij 81 van de 100 pogingen.

Om eerlijk te zijn: er is vaak een enorm verschil tussen de gratis/add-on-functies versus de dedicated enterprise botmanagementproducten van hetzelfde bedrijf. Tools zoals Cloudflare's Enterprise Bot Management gaan dieper met gedragssignalen. Maar ze komen ook met enterprise-prijzen die de meeste bedrijven niet kunnen rechtvaardigen.

Veel bedrijven waarmee we spreken realiseren zich niet hoeveel kwaadaardig verkeer ze toelaten in de veronderstelling dat het inschakelen van een "botbeveiliging"-knop van een WAF-leverancier alle verdediging is die ze nodig hebben.

Bonusmethode: Analysetools (Google Analytics, PostHog)

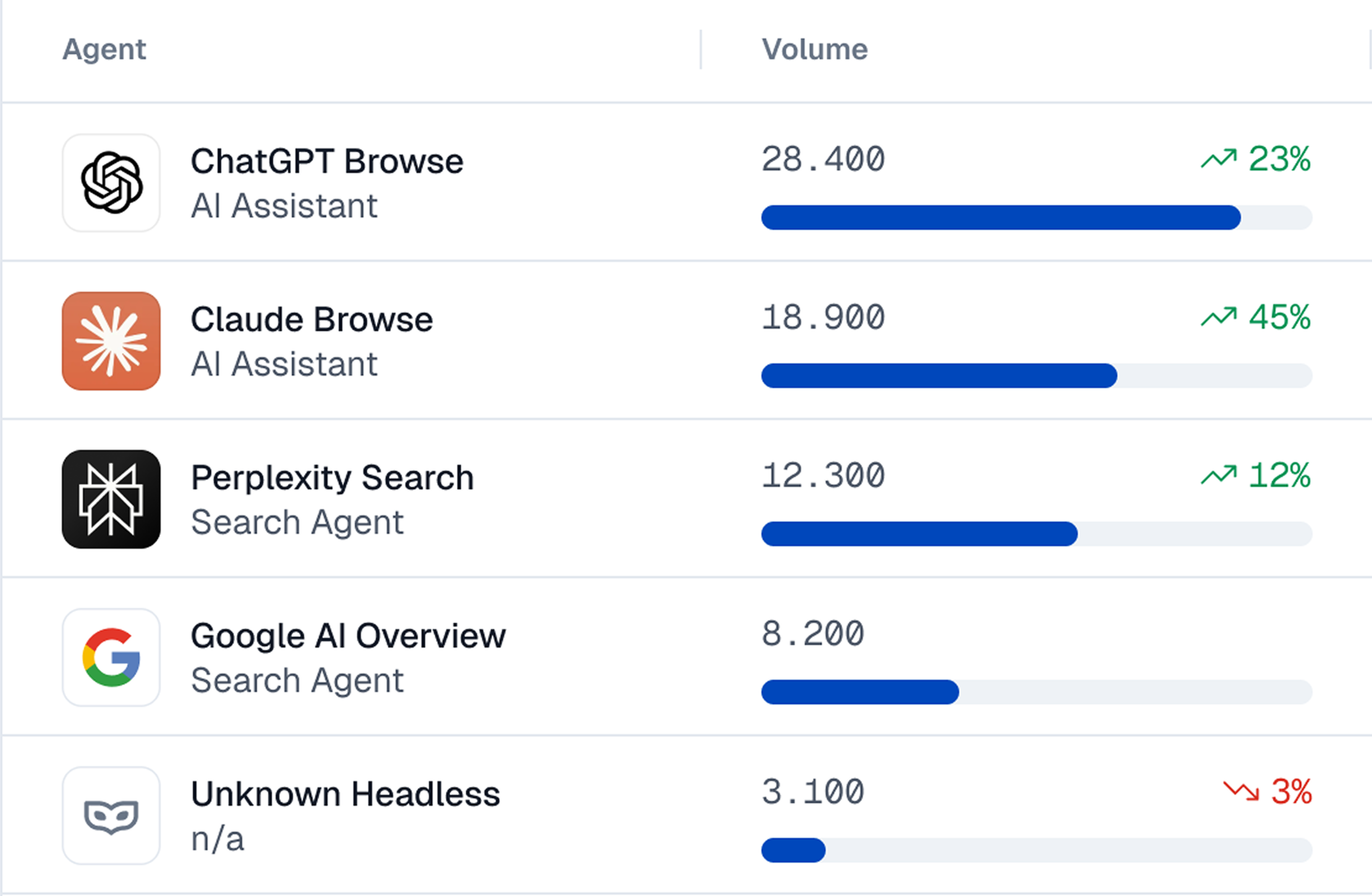

We merkten een piek op vanuit China, hoewel dat land geblokkeerd is via geo-blocking in Cloudflare. Bij nader onderzoek correleerde deze piek met een stijging in "Chrome"-gerelateerd verkeer.

Google Analytics en PostHog zijn geen botdetectietools. Maar we wilden ze opnemen als een gratis, directe (de meeste websites gebruiken deze tools al) en no-code optie waarmee je kunt experimenteren. Om duidelijk te zijn: standaard missen analysetools zoals GA4 AI-agentverkeer en categoriseren ze dit als "echte bezoekers". Ze kunnen geen onderscheid maken tussen een echte bezoeker en een Playwright-script dat je site in headless Chrome browst.

Dit is waarom ons onderzoek een 275% toename in forumdiscussies over botverkeer aantoonde dat de gebruikelijke verdedigingsmechanismen omzeilde en in Google Analytics verscheen.

Maar met aangepaste parameters kun je een deel van het agentische browserverkeer opvangen:

- Een stijging in verkeer van "Chrome" als browser. De meeste automatiseringsframeworks gebruiken standaard Chrome of "Chromium".

- Sessies vanuit landen die je al hebt geblokkeerd via geo-blocking. Onze Cloudflare-inrichting blokkeerde bijvoorbeeld China, maar GA4 laat nog steeds een heleboel verkeerspieken uit die regio zien.

- Plotseling verkeer vanuit specifieke steden, vaak Chinese steden, die geen logisch verband hebben met je bedrijf.

- Een enorme piek in verkeer van een bepaalde schermresolutie (bijv. 1270x980) en hetzelfde geografische gebied. Dit kan duiden op een botfarm die duizenden van hetzelfde apparaat gebruikt.

- Een onverklaarbare piek vanuit een willekeurig land. Bij ons ging Noorwegen van bijna nul naar 10.000+ sessies in één maand. Dit duidt op VPN's/roterende proxy's die op schaal door bots worden gebruikt.

De typen AI-agentverkeer op je website

Wanneer mensen aan AI-agentverkeer denken, is het eerste wat in hen opkomt crawlers. Crawlers vormen inderdaad een groot deel van geautomatiseerd verkeer, maar ze zijn slechts één categorie.

- AI-zoekcrawlers: Agents van AI-gedreven zoekmachines zoals Perplexity en Google AI Overviews. Ze bezoeken je site om content te verwerken in AI-gegenereerde zoekresultaten.

- LLM-trainingscrawlers: Bots zoals GPTBot, ClaudeBot en CCBot die je content scrapen om grote taalmodellen te trainen of bij te werken. De meeste identificeren zichzelf in hun User-Agent strings. Deze kunnen problematisch zijn voor websites met content die ze beschermd willen houden (kunst, teksten, muziek) en niet gebruikt voor het trainen van LLM's.

- Scrapers: Specifiek degenen die van buiten de grote AI-platforms komen. Aggregatiediensten die je data in concurrerende producten trekken, concurrenten die je prijzen monitoren, of piraterijoperaties die je content op schaal kopiëren.

- Gebruikersactie-agents (informatie ophalen): Een consument vraagt ChatGPT om je product te onderzoeken of vertelt Claude om prijzen te vergelijken bij drie leveranciers. Het platform stuurt een agent naar je site die pagina's bekijkt, content leest en het antwoord terugbrengt.

- Gebruikersactie-agents (taakuitvoering): Agents die door consumenten worden ingezet om taken uit te voeren. Perplexity Comet die een aankoop voltooit, een browserautomatisering die een PDF downloadt of een contactformulier invult. Ze klikken op knoppen, dienen formulieren in en navigeren flows net zoals een mens dat zou doen.

- Frauduleuze agents: Agents die expliciet voor kwaadaardige doeleinden zijn gebouwd. Bijvoorbeeld: batches gestolen creditcards testen tegen je betaalflow of tientallen accounts aanmaken om verwijzingsbonussen te misbruiken. Dit zijn bekende fraudepatronen, maar AI-agents maken ze goedkoper om in te zetten en moeilijker om op te vangen.

AI-zoekcrawlers en LLM-trainingscrawlers kunnen met relatief basale methoden worden opgespoord. Als je je zorgen maakt over frauduleuze agents, is een gespecialiseerde AI-agentdetectietool die specifiek gebouwd is voor fraudedetectie een betere optie.

AI-botdetectiesignalen die we bij cside gebruiken

| Signaallaag | Waar het naar kijkt |

|---|---|

| Identiteit | Wie de bezoeker beweert te zijn. User-Agent strings, botsignaturen en kruisverwijzingen met bekende crawlerlijsten. |

| Netwerk | Waar het verzoek vandaan komt. IP-reputatie, ASN-analyse (datacenter vs. residentieel), TLS-fingerprinting (JA3/JA4) en geografische consistentie tussen IP-locatie en browserinstellingen. |

| Browser/Apparaat | Of de browseromgeving echt is. Automatiseringsframework-artefacten (CDP-traces), Browser API-consistentie (WebGL, Canvas, Audio) en hardwareplausibiliteitscontroles. |

| Gedrag | Hoe de bezoeker daadwerkelijk met de pagina interacteert. Typsnelheid, navigatietiming, formulierinvulpatronen, muisbewegingen en klikplaatsing. |

Identiteitssignalen

- De meest eenvoudige manier om een AI-agent te identificeren is door te controleren wie ze beweren te zijn. Dit is waar robots.txt voor gebouwd is. Crawlers zoals GPTBot, ClaudeBot en GoogleBot identificeren zichzelf via User-Agent strings of andere signaturen/bot-identificatoren.

- Bij cside onderhouden we een lijst van bekende crawlersignaturen en controleren we inkomende User-Agents hiertegen, inclusief publiek gemarkeerde agressieve of kwaadaardige crawlers.

- De beperking is dat identiteitssignalen eenvoudig te spoofen zijn. Dit systeem is alleen betrouwbaar voor bots die ervoor kiezen zichzelf te declareren. Volgens Ahrefs komt tot 98% van het AI-verkeer van grote platforms (OpenAI, Anthropic, Google, Meta) die meestal via identiteitssignalen geïdentificeerd kunnen worden.

Andere opkomende benaderingen pakken het agentidentiteitsprobleem serieuzer aan. Zo geeft Browserbase, een platform waarmee gebruikers browserautomatiseringen kunnen maken, een AI-agent "paspoort" uit — een cryptografisch geverifieerde credential. Als dit de industriestandaard wordt voor browserautomatiseringstools, zou AI-verkeersfiltering makkelijker worden voor organisaties.

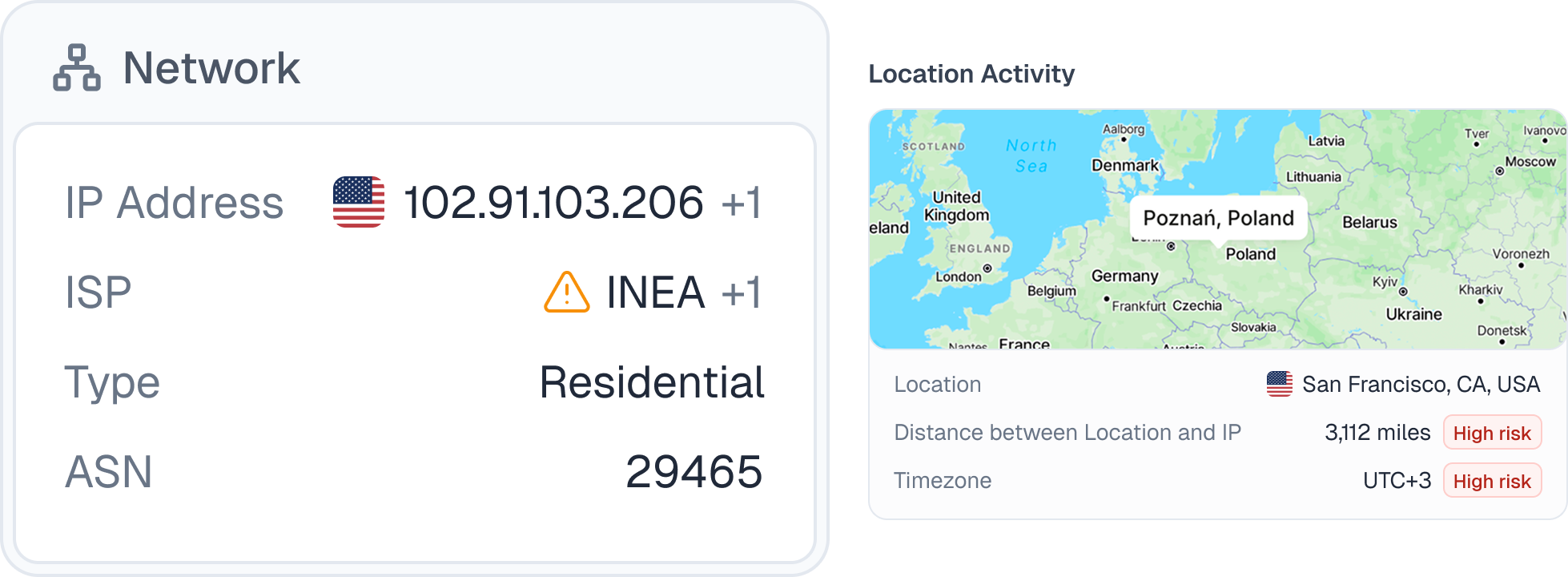

Netwerklaag-signalen

- IP-reputatie en ASN-analyse: Elk verzoek komt van een IP-adres dat gekoppeld is aan een Autonomous System Number (ASN). Datacenter-ASN's (AWS, GCP, Azure) zijn een sterke indicator van automatisering. Residentiële IP's zijn moeilijker te markeren, maar kruisverwijzingen met bekende proxynetwerken helpen.

- TLS-fingerprinting (JA3/JA4): Wanneer een browser verbinding maakt met je site, creëert de TLS-handshake een fingerprint die de echte clientsoftware identificeert. Als iemand beweert Chrome te zijn maar hun TLS-fingerprint eruitziet als een Python-script, heb je een mismatch gevonden.

- Geografische consistentie: Kruisverwijzing van IP-geolocatie met de tijdzone- en taalinstellingen van de browser. Als het IP naar Frankfurt verwijst maar de browser een tijdzone van Asia/Shanghai en een taal van zh-CN rapporteert, klopt er iets niet.

Browser/apparaat-laag signalen

- Automatiseringsframework-artefacten. Playwright en Puppeteer gebruiken het Chrome DevTools Protocol om de browser aan te sturen, en dit laat sporen achter. Enkele die we controleren zijn

cdc_-prefixen in window-objecten of toegankelijkheidselementen die zijn verwijderd. - Browser API-consistentie: WebGL, Canvas en Audio-context moeten een consistent verhaal vertellen over het apparaat. Wanneer een browser een krachtige GPU rapporteert via WebGL maar Canvas-output produceert die niet overeenkomt, of wanneer de Audio-context-fingerprint volledig ontbreekt, is er iets mee geknoeid.

- Hardwareplausibiliteit: De gedeclareerde GPU, schermresolutie en het besturingssysteem moeten logisch samenhangen. Een bezoeker met een 375x812 mobiele resolutie die een desktop NVIDIA GPU op Linux rapporteert, is geen echt apparaatprofiel.

Gedragssignalen

- Gedragsanalyse richt zich op hoe een bezoeker je site gebruikt. Typsnelheid, tijd tussen paginanavigaties, hoe formulieren worden ingevuld, scrolldiepte, muisbewegingspatronen. Zelfs geavanceerde automatisering heeft de neiging patronen (of anomalieën) te produceren die geïdentificeerd kunnen worden.

- Deze laag vereist constante evolutie. Agents worden slimmer en het detectiesignaal van gisteren kan vandaag al gepatcht zijn. Bij cside verzamelen we continu gedragsdata en draaien we AI-modellen hierop om nieuwe patronen te ontdekken naarmate het gedrag van agents verandert.

Klikplaatsing op knoppen is een concreet voorbeeld. Een van onze engineers, Martijn Cuppens, analyseerde drie populaire op browserextensies gebaseerde tools:

- Eén klikte op elke knop exact in het midden. Een andere klikte altijd iets rechts van het midden. De derde centreerde meestal maar plaatste af en toe een klik op een willekeurige positie binnen de knop — een opzettelijke poging om ruis te introduceren.

Dit is een van honderden gedragssignalen die we verzamelen en analyseren. Elk afzonderlijk signaal is misschien niet doorslaggevend. Samen bouwen ze een profiel op dat zeer moeilijk te vervalsen is.

Misvatting: AI-agents zullen websites alleen via API's en MCP gebruiken

Je hoort dit vaak: websites verschuiven naar API's en MCP en de browser doet er niet meer toe. Het is een profetisch narratief, maar het houdt geen stand en is zeker niet het geval vandaag:

- Google publiceerde een gids over het agent-ready maken van je website, en deze behandelt expliciet visuele UI-optimalisatie. Agents interacteren via DOM-parsing en visuele screenshots. Als Google dacht dat websites alleen API's zouden gebruiken, zouden ze je niet vertellen om je knoppen duidelijker en je layouts stabieler te maken.

- Een studie van Carnegie Mellon-onderzoekers vond dat hybride agents die zowel browsen als API-aanroepen gebruiken, significant beter presteerden dan API-only-interacties. Agents gebruikten beide modaliteiten in 77,7% van de taken. Zelfs met een goede API beschikbaar, vielen ze nog terug op de browser.

Waarom dit ertoe doet: agents browsen als mensen omdat dat het beste werkt. Ze klikken, scrollen, vullen formulieren in en navigeren pagina voor pagina. Dat gedrag is zichtbaar op de browserlaag. Je kunt een API-aanroep niet op dezelfde manier observeren als een agent die door je afrekenflow werkt. De browser is waar je ze vangt.

Waarom AI-agentdetectie anders is dan reguliere botdetectie

Stealth browsers en anti-detect frameworks

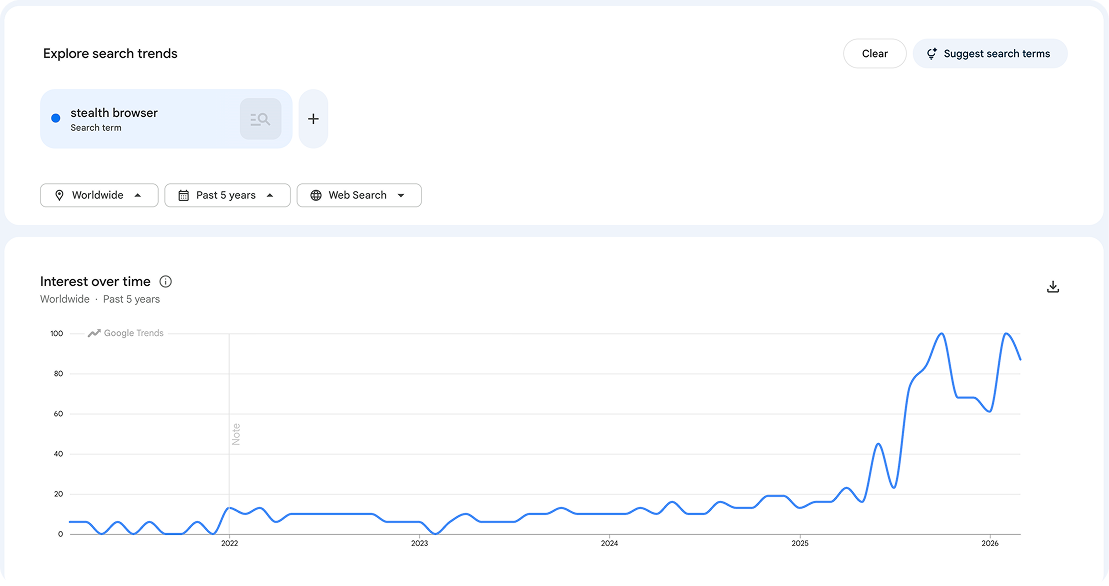

- Er is een hele categorie automatiseringstools die nu specifiek gebouwd zijn om onzichtbaar te zijn voor botdetectie, zoals Playwright met stealth-plugins of browser-use. Ze onderdrukken de

navigator.webdriver-vlag, spoofen Canvas- en WebGL-fingerprints en proberen de Chrome DevTools Protocol-sporen te verwijderen waar de meeste detectietools naar zoeken. - Dit is geen klein hoekje van het internet. De npm-installaties van Playwright verdrievoudigden tot meer dan 35 miljoen maandelijkse downloads. Google-zoekopdrachten naar "stealth browser" gingen van vlak naar continue all-time highs in de afgelopen twee jaar.

Lokaal gehoste automatisering

Traditionele bots draaiden op cloudservers (datacenter-IP's of virtuele machines). AI-agents draaien steeds vaker op echte consumenten-hardware. Iemand die een Claude-browserextensie op zijn persoonlijke laptop gebruikt, stuurt verzoeken vanuit een legitiem residentieel IP, een echte browser en authentieke apparaat-fingerprints.

Aanvallers kunnen dit gedrag repliceren door Playwright op lokale apparaten te draaien (Mac Mini's bijvoorbeeld), wat ononderscheidbaar lijkt van een consument die een apparaat gebruikt.

Van gescripte patronen naar op redenering gebaseerde automatisering

Traditionele bots volgden scripts. Stap één, stap twee, stap drie. Die voorspelbaarheid maakte ze te vangen. AI-agents redeneren nu over de pagina, beslissen wat ze vervolgens doen en passen zich aan wanneer er iets onverwachts gebeurt.

CAPTCHAs zijn nu ook geen betrouwbaar vangnet meer. AI-visiemodellen lossen CAPTCHAs sneller en betrouwbaarder op dan mensen.

Hoe onderscheid te maken tussen kwaadaardige AI-agents en consumenten-AI-agents

Er is een nieuwe vector om rekening mee te houden bij botdetectie. Een deel van het "AI-agentverkeer" komt van consumenten die agents naar je site sturen.

- Perplexity Comet doet aankopen namens gebruikers. Amazon Buy for Me controleert voorraad en voltooit bestellingen. Base44 boekt reserveringen. Dit zijn echte producten met echte consumentenadoptie, geen prototypes.

Zoals beschreven in ons AI-agent onderzoeksrapport, nam "user action" AI-botverkeer met meer dan 15x toe in 2025. Alle automatisering nu blokkeren betekent potentiële omzet blokkeren of op zijn minst de koopervaring vertragen.

Van "bot of niet" naar intentieclassificatie

Jarenlang was botdetectie binair. Is dit een bot? Ja? Blokkeren. Dit werkt niet meer wanneer je klanten degenen zijn die de bots sturen. Of wanneer je de SEO/AEO-zichtbaarheid waardeert die crawlers opleveren.

- De nieuwe aanpak is intentieclassificatie: In plaats van te vragen "is dit een bot," vraag je "wat probeert deze bot te doen?" Het antwoord bepaalt of je het toestaat, monitort, uitdaagt of blokkeert.

Signalen voeden een risicoscore. Als een bezoeker 17 creditcards in drie minuten testte, is dat een kaartenumeratie-aanval. Als een sessie automatiseringssignalen vertoont en meerdere accounts op je site aanmaakt, kan dat multi-accounting zijn (meerdere accounts om gratis proefperiodes of aanmeldingsbonussen te misbruiken). Botdetectie, fingerprinting en accountactiviteitssignalen werken samen om handhavingsacties te triggeren wanneer geautomatiseerde activiteit eruitziet als frauduleuze activiteit.

Waarom je website-analysetools AI-agentverkeer niet opvangen

AI-crawlers en scrapers zoals GPTBot en ClaudeBot voeren helemaal geen JavaScript uit. Ze vragen je HTML op, extraheren de content en gaan verder. Je analytics-snippet wordt nooit afgevuurd, dus deze bezoeken verschijnen nooit in GA4, PostHog of Amplitude.

Browsergebaseerde AI-agents hebben het tegenovergestelde probleem. Ze werken in echte browsers en genereren sessiedata die eruitziet als van een mens. GA4 en andere analysetools tellen ze dus als echte gebruikers.

Wat te doen wanneer je AI-agentverkeer detecteert

Blokkeer niet standaard

Het is verleidelijk om alles te blokkeren dat er geautomatiseerd uitziet, maar blindelings blokkeren schaadt je op twee manieren. Je verliest zicht op wat er daadwerkelijk op je site gebeurt, en je blokkeert consumenten-agents die proberen je producten te kopen of je merk aan te bevelen via AI-zoekresultaten.

Adaptieve responsstrategieën voor AI-agentverkeer

- Omleiden of agent-specifieke content aanbieden: Een verzekeringsmaatschappij waarmee we samenwerken ontdekte bots die door hun offerteflow liepen om prijzen te scrapen. Hun oplossing: wanneer een bot werd gedetecteerd in de offerteflow, toonde de laatste stap een "neem contact op"-scherm in plaats van de gegenereerde offerte. Er lekten geen prijsgegevens naar concurrenten/aggregatieplatforms. In het geval van een vals positief kon een mens nog steeds het verkoopproces voortzetten.

- Pas de ervaring aan. In plaats van een agent te blokkeren, geef je deze een speciaal gebouwde weergave. Een pagina die erkent "we hebben je geïdentificeerd als een AI-agent, hier is een geoptimaliseerde versie" laat consumenten-agents de informatie krijgen die ze nodig hebben terwijl je menselijke bezoekers de volledige ervaring zien.

We hebben een volledige gids die verschillende fraudescenario's behandelt: Hoe frauduleuze AI-agents op je website te blokkeren.

Hoe cside AI-bot- en agentische browserdetectie oplost

cside is een webbeveiligingsplatform gespecialiseerd in het monitoren van de browser-runtime. cside's AI-agentdetectie is specifiek gebouwd om frauduleuze AI-agents op je website te identificeren. Met cside:

- Krijg een dashboard van welke agents je site benaderen en wat ze doen

- Automatische risicoscores op basis van gedragssignalen om kwaadaardige AI-agents (inclusief browsergebaseerde en lokaal gehoste) op te vangen die traditionele botverdediging omzeilen

- Voed detectiesignalen in je eigen handhavingsworkflows

- Voorkom AI-agentfraude zoals promotiecode-misbruik, contentpiraterij, creditcardtesting, kwetsbaarheidsontdekking en geavanceerde scraping