TL;DR

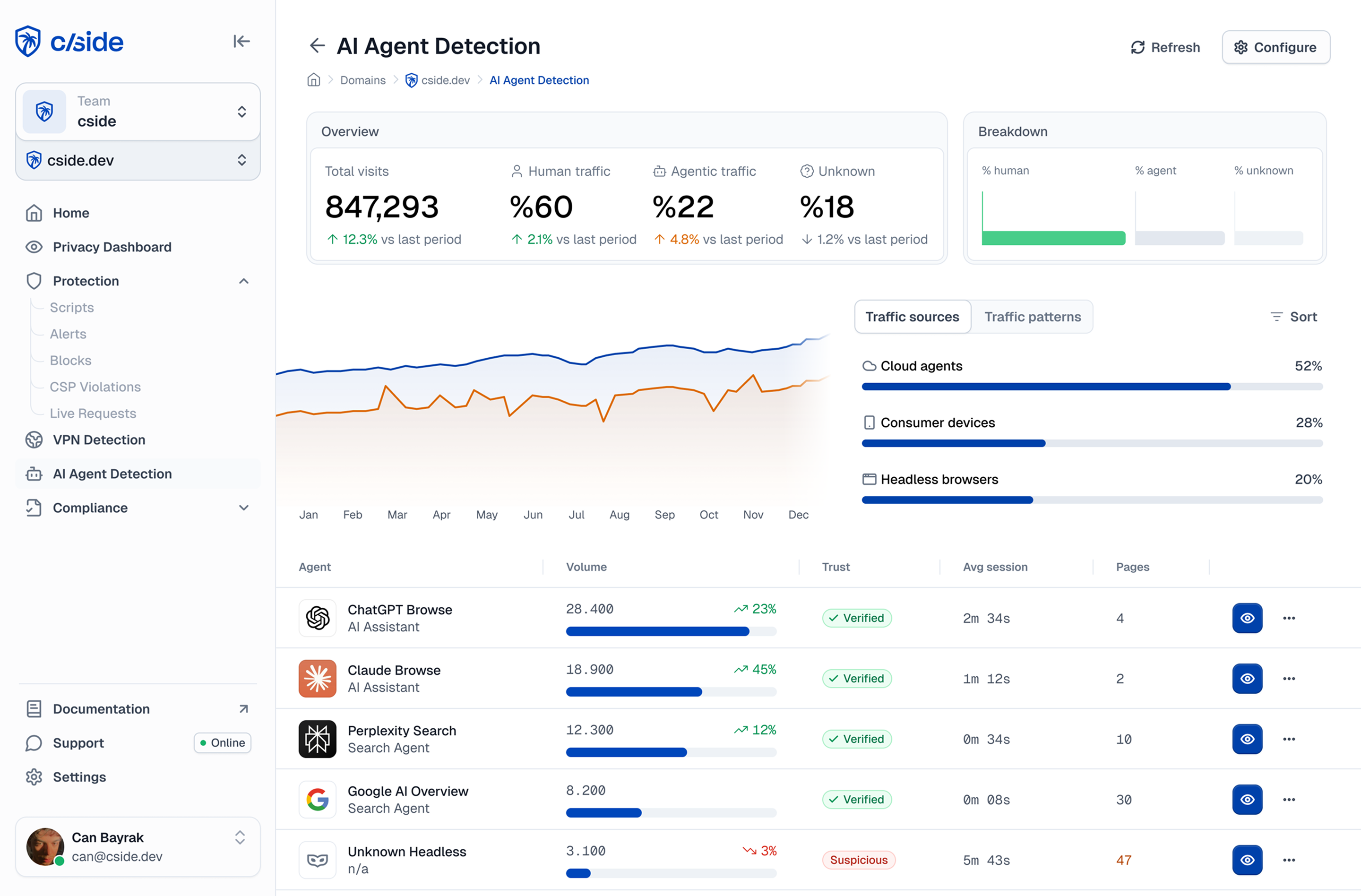

- Os métodos utilizados para identificar tráfego de agentes de IA são: análise de logs de servidor, ferramentas tradicionais de deteção de bots (ex.: Cloudflare ou Akamai), ou ferramentas especializadas de deteção de agentes de IA como a cside.

- As ferramentas especializadas de deteção de agentes de IA analisam quatro categorias de sinais: identidade, rede, navegador e comportamento.

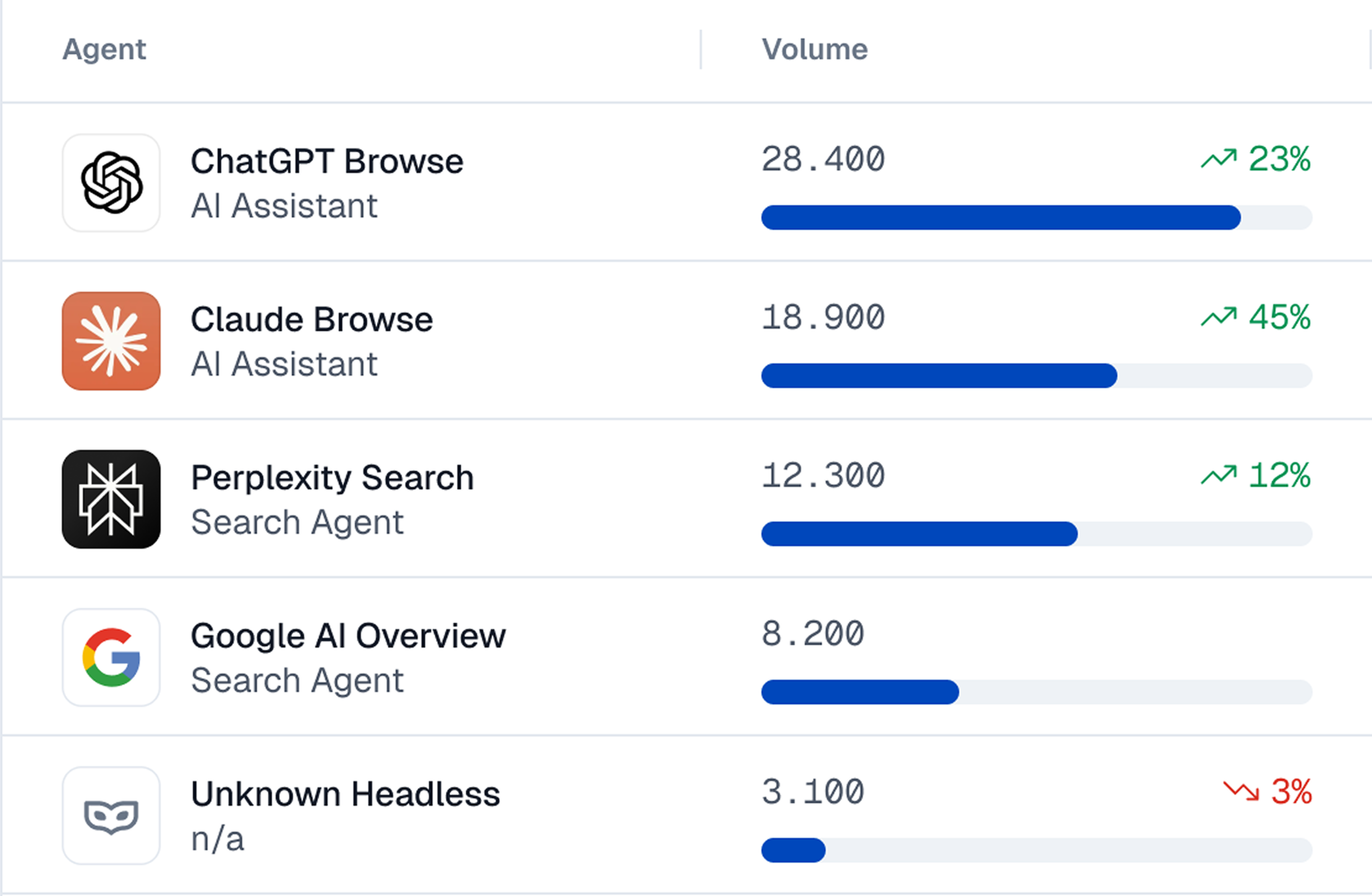

- As ferramentas de análise de websites como Google Analytics ou PostHog normalmente não detetam o tráfego de agentes de IA ou classificam estes visitantes como humanos reais.

- Agentes de IA relacionados com crawlers são mais fáceis de identificar (com métodos DIY ou ferramentas gratuitas), mas apanhar agentes 'anti-deteção' construídos para fins fraudulentos requer um conjunto de ferramentas completamente diferente.

- 81% dos testes internos da cside conseguiram contornar a deteção de bots de plataformas legadas com bots baseados em agentes de IA.

3 métodos para detectar agentes de IA no seu website

Tabela resumo: Detectar tráfego de agentes de IA no seu website

| Logs de Servidor | Deteção Especializada de Agentes de IA | Deteção Tradicional de Bots | Ferramentas de Análise | |

|---|---|---|---|---|

| O que deteta | Crawlers conhecidos que se auto-identificam (GPTBot, ClaudeBot, etc.) | Agentes stealth, bots baseados em navegador, agentes alojados localmente, automação fraudulenta | Bots com scripts, IPs maliciosos conhecidos, abuso básico de taxa | Anomalias de tráfego e padrões que indicam atividade de bots |

| Profundidade de segurança | Não deteta agentes que falsificam o User-Agent ou não se declaram | Cobertura não é 100% perfeita, mas a opção mais forte no panorama atual | Navegadores stealth, proxies residenciais, agentes alojados localmente | Não consegue distinguir sessões de agentes de IA de sessões humanas |

| Como configurar | Verifique o painel do CDN (Cloudflare, Vercel) ou analise os logs de acesso Nginx/Apache | Adicione um snippet JS ao seu site (semelhante a instalar uma ferramenta de análise) | Ative a proteção contra bots no painel do CDN; planos enterprise requerem contratos | Configure dimensões personalizadas no GA4 ou PostHog para identificar anomalias |

| Custo | Gratuito | A cside tem planos Free, Small Business e Enterprise | Gratuito (básico) a preços enterprise | Gratuito |

| Melhor para | Primeira análise rápida da atividade de crawlers conhecidos | Identificar agentes fraudulentos | Bloquear bots comuns e padrões maliciosos conhecidos | Perceber que algo está errado antes de saber o que é |

Detalhamos sinais específicos a procurar nas camadas de rede, navegador e comportamento mais abaixo neste blog.

Método 1: Analisar logs de servidor

- Como funciona: Cada vez que alguém (incluindo bots) visita o seu website, o servidor regista o que afirmou ser. Muitos bots de IA revelam o seu nome. O bot da OpenAI diz "GPTBot," o da Anthropic diz "ClaudeBot,". Para confirmar que um crawler é legítimo e não falsificado, cruze o IP do pedido com os intervalos de IP oficialmente publicados pelo crawler.

- Como configurar: Se usa um CDN ou plataforma de alojamento, verifique os painéis primeiro. Cloudflare, Vercel e Netlify já estão sobre os seus logs de servidor e apresentam esta informação num painel. Para sites auto-alojados, o seu servidor web (Nginx, Apache) mantém logs de acesso que pode descarregar ou pesquisar com ferramentas de linha de comandos.

- Limitações: Isto só funciona com bots que escolhem ser honestos. Tanto as defesas baseadas em strings de user-agent como em intervalos de IP podem ser facilmente contornadas. Os bots verdadeiramente perigosos não se anunciam. E agentes baseados em navegador como o Atlas do ChatGPT ou o OpenClaw têm menor probabilidade de se identificarem através de strings de user-agent.

Método 2: Ferramentas especializadas de deteção de agentes de IA

Uma nova categoria de ferramentas de deteção surgiu especificamente para lidar com agentes de IA, porque o problema vai muito além de scraping e crawling. 78% dos CTOs de instituições financeiras inquiridos pela Accenture esperam um aumento de fraude impulsionada por agentes de IA para compras.

- Como funciona: Estas ferramentas monitorizam dezenas de sinais em 4 camadas de deteção: identidade (quem o visitante afirma ser), rede (de onde se está a ligar), ambiente do navegador (como é o runtime), e comportamento (como interage realmente com a página). Ao cruzar sinais nas quatro camadas, conseguem apanhar agentes que passariam qualquer verificação individual isolada.

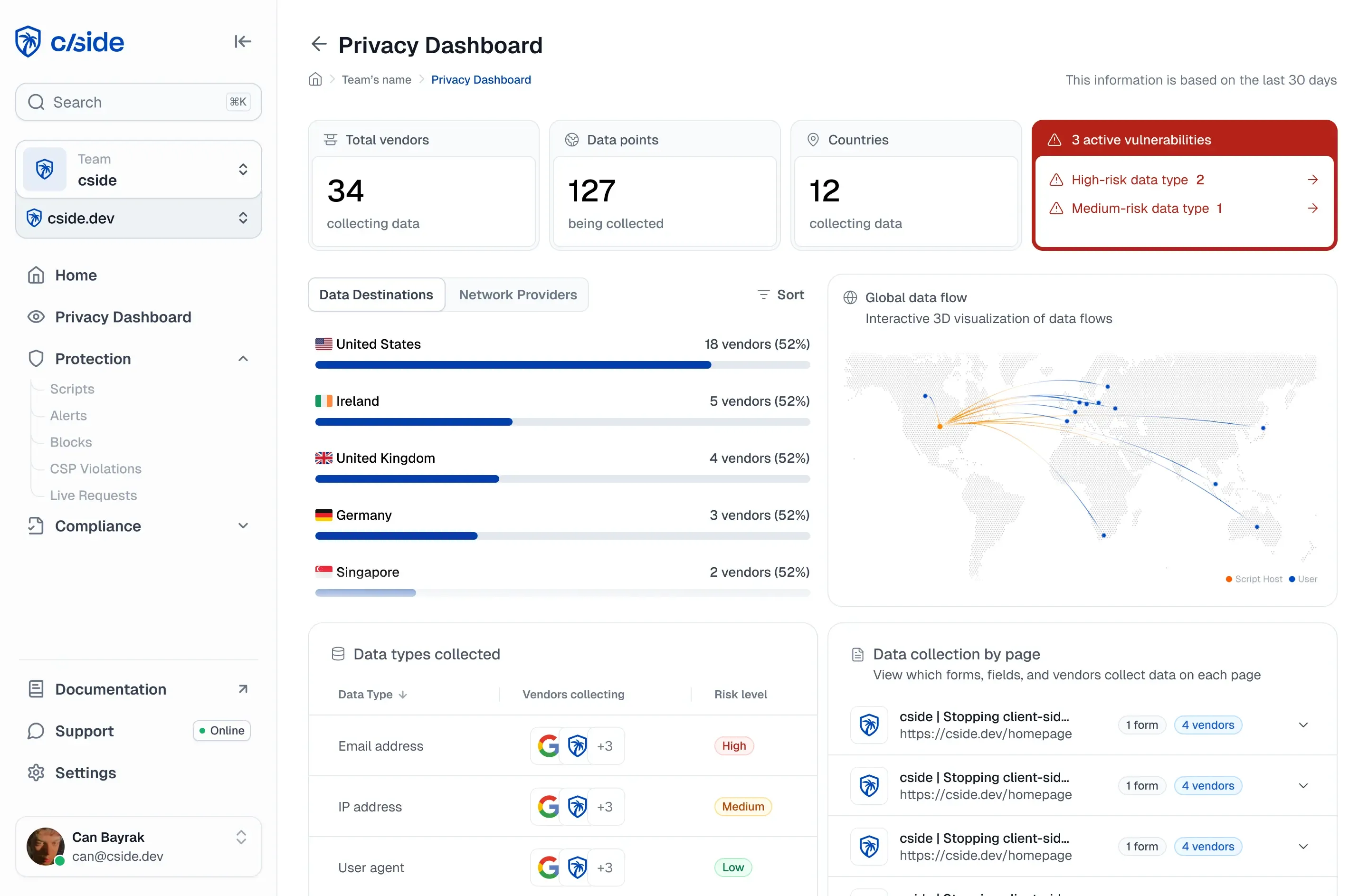

- Como configurar: A maioria destas ferramentas (como a cside) é instalada adicionando um snippet JavaScript ao seu site, de forma semelhante à instalação de uma ferramenta de análise. Uma vez instalada, a cside monitoriza instantaneamente a atividade nas quatro camadas de sinais e mostra-lhe um painel com os visitantes que são humanos, os que são agentes conhecidos e os que são suspeitos.

Detalhamos os sinais que usamos na nossa própria deteção de agentes de IA mais abaixo neste blog.

Método 3: Ferramentas tradicionais de deteção de bots

Ferramentas como Cloudflare Bot Fight Mode e Akamai Bot Manager foram construídas para apanhar tráfego automatizado. São o ponto de partida mais comum para defesa contra bots, e um que muitas equipas já têm implementado.

- Como funcionam: Estas ferramentas analisam pedidos recebidos usando uma combinação de reputação de IP, impressões digitais TLS (JA3/JA4), consistência de cabeçalhos e mecanismos de desafio-resposta como CAPTCHAs.

- Como configurar: A maioria dos fornecedores de CDN oferece um botão básico de proteção contra bots no seu painel. Outras plataformas dedicadas podem requerer um snippet JS ou configuração de proxy reverso, além de uma conversa contratual.

Limitações: Muitos fornecedores de segurança colaram "deteção de bots de IA" nas suas páginas de produto no último ano sem mudar adequadamente como a deteção funciona por baixo. Os "add-ons" gratuitos ou de baixo custo para deteção de agentes de IA dependem largamente de procurar padrões básicos de automação ou verificações tipo CAPTCHA, falhando muitos dos agentes maliciosos.

Alguns dos nossos engenheiros na cside fizeram um teste ao lançar bots baseados em agentes de IA contra duas grandes plataformas de deteção de bots, e contornámos a deteção em 81 de 100 tentativas.

Para ser justo, existe frequentemente uma diferença enorme entre as funcionalidades gratuitas/add-on e os produtos dedicados de gestão de bots enterprise da mesma empresa. Ferramentas como o Enterprise Bot Management da Cloudflare vão mais fundo com sinais comportamentais. Mas também têm preços enterprise que a maioria das empresas não consegue justificar.

Muitas das empresas com quem falamos não percebem quanto tráfego malicioso permitem, sob a impressão de que ligar um botão de "proteção contra bots" de um fornecedor de WAF é toda a defesa que precisam.

Método bónus: Ferramentas de análise (Google Analytics, PostHog)

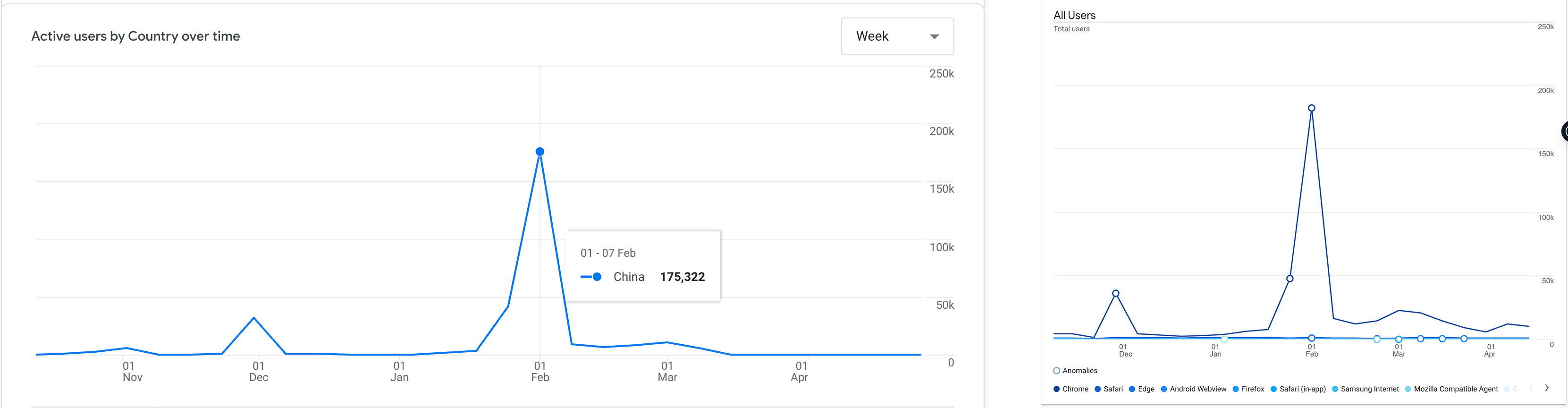

Notámos um pico vindo da China apesar de esse país estar geo-bloqueado no Cloudflare. Após inspeção, este pico correlacionou-se com um aumento de tráfego relacionado com "Chrome".

Google Analytics e PostHog não são ferramentas de deteção de bots. Mas quisemos incluí-las como uma opção gratuita, instantânea (a maioria dos websites já usa estas ferramentas) e sem código com que pode experimentar. Para ser claro - por defeito, ferramentas de análise como GA4 não detetam tráfego de agentes de IA e categorizam-nos como "visitantes reais". Não conseguem distinguir entre um visitante real e um script Playwright a navegar o seu site em Chrome headless.

É por isso que a nossa investigação encontrou um aumento de 275% nas discussões em fóruns sobre tráfego de bots que contornou os mecanismos de defesa habituais e apareceu no Google Analytics.

Mas com parâmetros personalizados pode apanhar algum tráfego de navegadores agênticos:

- Um aumento de tráfego com "Chrome" como navegador. A maioria dos frameworks de automação usa Chrome ou "Chromium" por defeito.

- Sessões de países que já geo-bloqueou. Por exemplo, a nossa configuração de Cloudflare bloqueou a China mas o GA4 continua a mostrar imensos picos de tráfego dessa região.

- Tráfego súbito de cidades específicas, frequentemente cidades chinesas, que não fazem sentido para o seu negócio.

- Um pico massivo de tráfego de uma resolução de ecrã particular (ex.: 1270x980) e da mesma área geográfica. Isto pode indicar uma farm de bots que usa milhares do mesmo dispositivo.

- Um pico inexplicável de um país aleatório. Tivemos a Noruega a passar de quase zero para mais de 10.000 sessões num único mês. Isto indica VPNs/proxies rotativos usados em escala por bots.

Os tipos de tráfego de agentes de IA no seu website

Quando as pessoas pensam em tráfego de agentes de IA, a primeira coisa que vem à mente são os crawlers. Os crawlers constituem de facto uma grande parcela do tráfego automatizado, mas são apenas uma categoria.

- Crawlers de pesquisa de IA: Agentes de motores de pesquisa alimentados por IA como Perplexity e Google AI Overviews. Visitam o seu site para extrair conteúdo para resultados de pesquisa gerados por IA.

- Crawlers de treino de LLMs: Bots como GPTBot, ClaudeBot e CCBot que extraem o seu conteúdo para treinar ou atualizar grandes modelos de linguagem. A maioria identifica-se nas strings de User-Agent. Estes podem ser problemáticos para websites com conteúdo que querem proteger (obras de arte, escrita, música) e não usar para treinar LLMs.

- Scrapers: Especificamente, os que vêm de fora das grandes plataformas de IA. Serviços de agregação a puxar os seus dados para produtos concorrentes, concorrentes a monitorizar os seus preços, ou operações de pirataria a copiar o seu conteúdo em escala.

- Agentes de ação do utilizador (recuperação de informação): Um consumidor pede ao ChatGPT para pesquisar o seu produto ou diz ao Claude para comparar preços em três fornecedores. A plataforma envia um agente ao seu site que navega páginas, lê conteúdo e traz a resposta de volta.

- Agentes de ação do utilizador (execução de tarefas): Agentes lançados por consumidores para cumprir tarefas. Perplexity Comet a completar uma compra, uma automação de navegador a descarregar um PDF ou a preencher um formulário de contacto. Clicam em botões, submetem formulários e navegam fluxos tal como um humano faria.

- Agentes fraudulentos: Agentes construídos para fins explicitamente maliciosos. Por exemplo - testar lotes de cartões de crédito roubados contra o seu fluxo de pagamento ou criar dezenas de contas para abusar de bónus de referência. Estes são padrões de fraude familiares, mas os agentes de IA tornam-nos mais baratos de lançar e mais difíceis de apanhar.

Os crawlers de pesquisa de IA e os crawlers de treino de LLMs podem ser apanhados com métodos relativamente básicos. Se está preocupado com agentes fraudulentos, uma ferramenta especializada de deteção de agentes de IA construída especificamente para deteção de fraude é uma opção melhor.

Sinais de deteção de bots de IA que usamos na cside

| Camada de Sinal | O Que Analisa |

|---|---|

| Identidade | Quem o visitante afirma ser. Strings de User-Agent, assinaturas de bots e cruzamento com listas de crawlers conhecidos. |

| Rede | De onde vem o pedido. Reputação de IP, análise de ASN (datacenter vs. residencial), impressão digital TLS (JA3/JA4) e consistência geográfica entre localização do IP e definições do navegador. |

| Navegador/Dispositivo | Se o ambiente do navegador é real. Artefactos de frameworks de automação (traces CDP), consistência de APIs do navegador (WebGL, Canvas, Audio) e verificações de plausibilidade de hardware. |

| Comportamental | Como o visitante realmente interage com a página. Velocidade de digitação, tempo entre navegações, padrões de preenchimento de formulários, movimentos do rato e posição dos cliques. |

Sinais de identidade

- A forma mais direta de identificar um agente de IA é verificar quem afirma ser. É para isto que o robots.txt foi criado. Crawlers como GPTBot, ClaudeBot e GoogleBot identificam-se através de strings de User-Agent ou outras assinaturas/identificadores de bots.

- Na cside, mantemos uma lista de assinaturas de crawlers conhecidos e cruzamos os User-Agents recebidos com ela, incluindo crawlers publicamente sinalizados como agressivos ou maliciosos.

- A limitação é que os sinais de identidade são facilmente falsificáveis. Este sistema só é fiável para bots que escolhem auto-declarar-se. Segundo a Ahrefs, até 98% do tráfego de IA vem de grandes plataformas (OpenAI, Anthropic, Google, Meta) que normalmente podem ser identificadas através de sinais de identidade.

Outras abordagens emergentes tratam o problema de identidade dos agentes de forma mais séria. Por exemplo, a Browserbase, uma plataforma que permite aos utilizadores criar automações de navegador, emite um "passaporte" de agente de IA que é uma credencial verificada criptograficamente. Se isto se tornar padrão da indústria em ferramentas de automação de navegador, a filtragem de tráfego de IA tornar-se-ia mais fácil para as organizações.

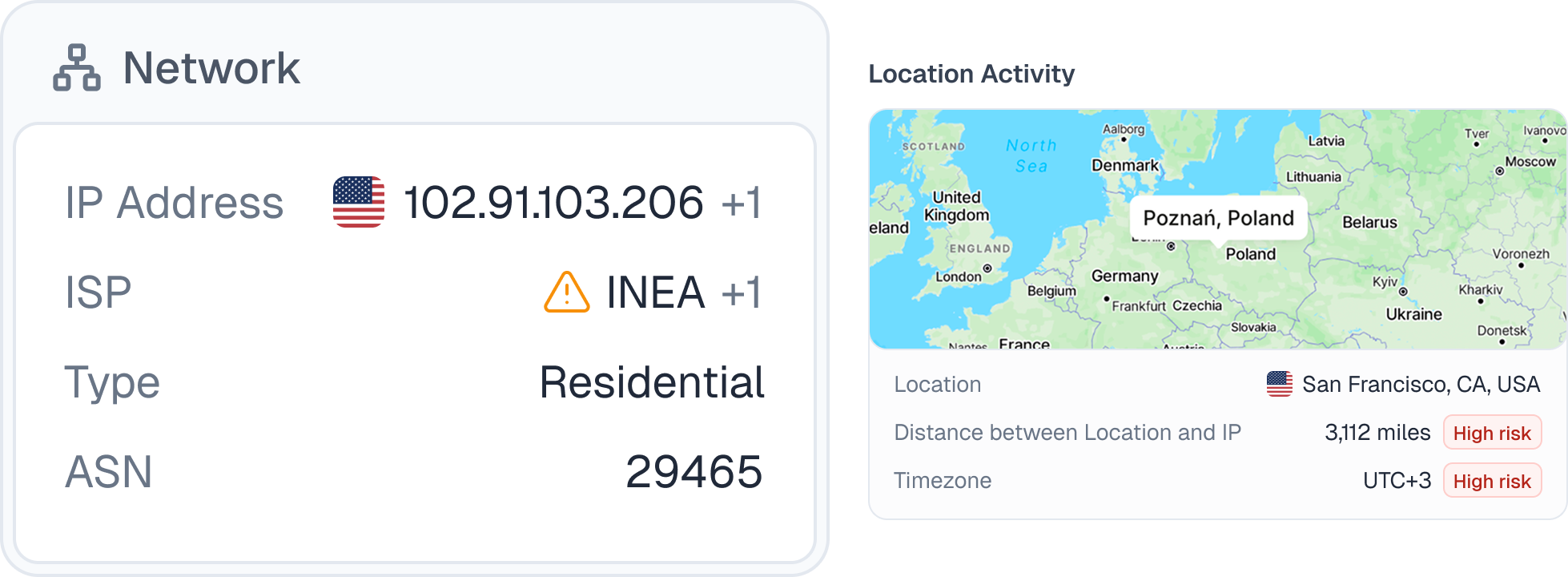

Sinais da camada de rede

- Reputação de IP e análise de ASN: Cada pedido origina de um endereço IP associado a um Autonomous System Number (ASN). ASNs de datacenters (AWS, GCP, Azure) são um forte indicador de automação. IPs residenciais são mais difíceis de sinalizar, mas o cruzamento com redes de proxy conhecidas ajuda.

- Impressão digital TLS (JA3/JA4): Quando um navegador se liga ao seu site, o handshake TLS cria uma impressão digital que identifica o verdadeiro software cliente. Se alguém afirma ser Chrome mas a sua impressão digital TLS parece um script Python, apanhou uma inconsistência.

- Consistência geográfica: Cruze a geolocalização do IP com o fuso horário e as definições de idioma do navegador. Se o IP resolve para Frankfurt mas o navegador reporta um fuso horário de Asia/Shanghai e um idioma de zh-CN, algo não bate certo.

Sinais da camada de navegador/dispositivo

- Artefactos de frameworks de automação. Playwright e Puppeteer usam o Chrome DevTools Protocol para controlar o navegador, e isto deixa pistas. Alguns que procuramos são prefixos

cdc_em objetos window ou elementos de acessibilidade que foram removidos. - Consistência de APIs do navegador: WebGL, Canvas e Audio context devem contar uma história coerente sobre o dispositivo. Quando um navegador reporta uma GPU potente via WebGL mas produz output de Canvas que não corresponde, ou quando a impressão digital do Audio context está completamente ausente, algo foi adulterado.

- Plausibilidade de hardware: A GPU declarada, resolução de ecrã e sistema operativo precisam de fazer sentido juntos. Um visitante com uma resolução móvel de 375x812 a reportar uma GPU NVIDIA de desktop em Linux não é um perfil de dispositivo real.

Sinais comportamentais

- A análise comportamental foca-se em como um visitante usa o seu site. Velocidade de digitação, tempo entre navegações de página, como os formulários são preenchidos, profundidade de scroll, padrões de movimento do rato. Mesmo automação sofisticada tende a produzir padrões (ou anomalias) que podem ser identificados.

- Esta camada requer evolução constante. Os agentes ficam mais inteligentes, e o sinal de deteção de ontem pode ser corrigido hoje. Na cside, recolhemos continuamente dados comportamentais e executamos modelos de IA contra eles para identificar novos padrões à medida que o comportamento dos agentes muda.

A posição dos cliques em botões é um exemplo concreto. Um dos nossos engenheiros, Martijn Cuppens, analisou três ferramentas populares baseadas em extensões de navegador:

- Uma clicava em cada botão exatamente no centro. Outra clicava sempre ligeiramente descentrada para a direita. A terceira centrava na maioria das vezes mas ocasionalmente colocava um clique numa posição aleatória dentro do botão, uma tentativa intencional de introduzir ruído.

Este é um de centenas de sinais comportamentais que recolhemos e analisamos. Cada um sozinho pode não ser conclusivo. Juntos, constroem um perfil muito difícil de falsificar.

Equívoco: os agentes de IA só vão usar websites através de APIs e MCP

Vai ouvir isto muitas vezes: os websites vão migrar para APIs e MCP e o navegador deixará de importar. É uma narrativa profética, mas não se sustenta e certamente não é o caso hoje:

- A Google publicou um guia sobre como preparar o seu website para agentes, e cobre explicitamente a otimização visual da interface. Os agentes interagem através de parsing do DOM e capturas de ecrã visuais. Se a Google achasse que os websites iam ser só API, não estaria a dizer-lhe para tornar os seus botões mais claros e os seus layouts mais estáveis.

- Um estudo de investigadores da Carnegie Mellon descobriu que agentes híbridos que usam tanto navegação como chamadas de API superaram significativamente as interações apenas por API. Os agentes usaram ambas as modalidades em 77,7% das tarefas. Mesmo com uma boa API disponível, recorreram ao navegador.

Porque é que isto importa: os agentes navegam como humanos porque é o que funciona melhor. Clicam, fazem scroll, preenchem formulários e navegam página a página. Esse comportamento é visível ao nível do navegador. Não se consegue observar uma chamada de API da mesma forma que se observa um agente a trabalhar através do seu fluxo de checkout. O navegador é onde os apanha.

Porque é que a deteção de agentes de IA é diferente da deteção regular de bots

Navegadores stealth e frameworks anti-deteção

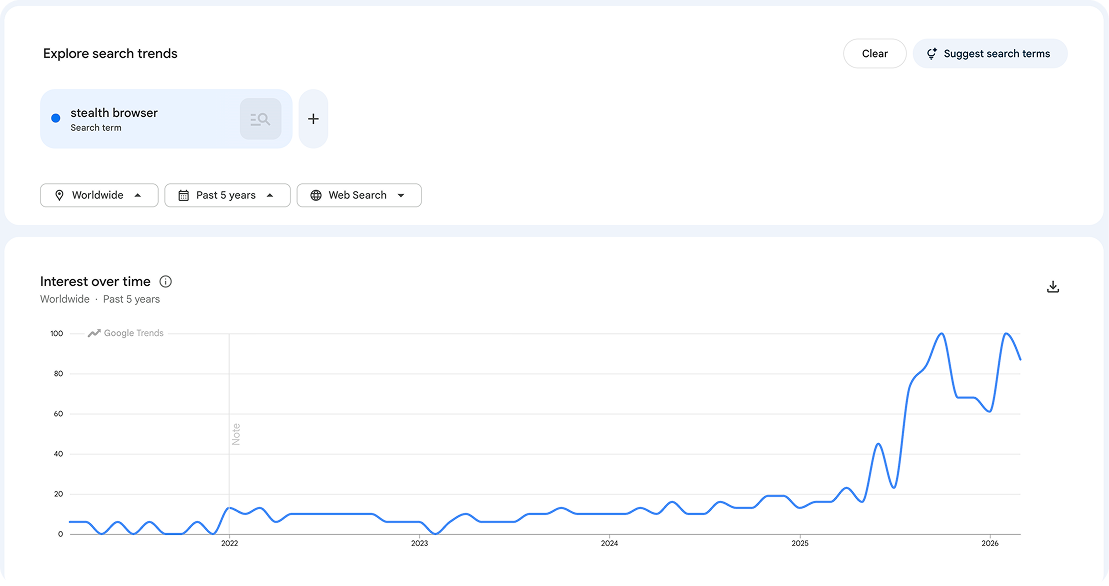

- Existe toda uma categoria de ferramentas de automação agora construídas especificamente para serem invisíveis à deteção de bots, como Playwright com plugins stealth ou browser-use. Suprimem a flag

navigator.webdriver, falsificam impressões digitais de Canvas e WebGL, e tentam eliminar os traces do Chrome DevTools Protocol que a maioria das ferramentas de deteção procura. - Isto não é um canto pequeno da internet. As instalações npm do Playwright triplicaram para mais de 35 milhões de downloads mensais. As pesquisas no Google por "stealth browser" passaram de estáveis para máximos históricos contínuos nos últimos dois anos.

Automação alojada localmente

Os bots tradicionais corriam em servidores cloud (IPs de datacenter ou máquinas virtuais). Os agentes de IA correm cada vez mais em hardware real de consumidores. Alguém que usa uma extensão de navegador do Claude no seu portátil pessoal envia pedidos de um IP residencial legítimo, um navegador real e impressões digitais de dispositivo autênticas.

Os atacantes podem replicar este comportamento ao correr Playwright em dispositivos locais (Mac Minis, por exemplo), o que parece indistinguível de um consumidor a usar um dispositivo.

De padrões com script para automação baseada em raciocínio

Os bots tradicionais seguiam scripts. Passo um, passo dois, passo três. Essa previsibilidade é o que os tornava detetáveis. Os agentes de IA agora raciocinam sobre a página, decidem o que fazer a seguir e adaptam-se quando algo inesperado acontece.

Os CAPTCHAs também já não são uma barreira fiável. Os modelos de visão de IA resolvem CAPTCHAs mais rápido e com mais fiabilidade do que os humanos.

Como distinguir entre agentes de IA maliciosos e agentes de IA de consumidores

Há um novo vetor a considerar no que toca à deteção de bots. Uma parte do "tráfego de agentes de IA" vem de consumidores que enviam agentes ao seu site.

- Perplexity Comet faz compras em nome dos utilizadores. Amazon Buy for Me verifica inventário e completa encomendas. Base44 faz reservas. Estes são produtos reais com adoção real por consumidores, não protótipos.

Conforme abordado no nosso relatório de investigação sobre agentes de IA, o tráfego de bots de IA de "ação do utilizador" aumentou mais de 15x ao longo de 2025. Bloquear toda a automação agora significa bloquear receita potencial ou, no mínimo, abrandar a experiência de compra.

De "bot ou não" para classificação de intenção

Durante anos, a deteção de bots era binária. Isto é um bot? Sim? Bloqueia. Isto deixa de funcionar quando os seus clientes são quem envia os bots. Ou quando valoriza a visibilidade de SEO/AEO que vem dos crawlers.

- A nova abordagem é a classificação de intenção: Em vez de perguntar "isto é um bot," pergunta "o que é que este bot está a tentar fazer?" A resposta determina se o permite, monitoriza, desafia ou bloqueia.

Os sinais alimentam uma pontuação de risco. Se um visitante testou 17 cartões de crédito em três minutos, isso é um ataque de enumeração de cartões. Se uma sessão mostra sinais de automação e está a criar múltiplas contas no seu site, isso pode ser multi-accounting (múltiplas contas para explorar períodos de teste gratuito ou bónus de registo). A deteção de bots, o fingerprinting e os sinais de atividade de conta trabalham juntos para acionar ações de enforcement quando a atividade automatizada se assemelha a atividade fraudulenta.

Porque é que as suas ferramentas de análise de website não detetam tráfego de agentes de IA

Os crawlers e scrapers de IA como GPTBot e ClaudeBot não executam JavaScript de todo. Fazem o pedido do seu HTML, extraem o conteúdo e seguem em frente. O seu snippet de análise nunca dispara, por isso estas visitas nunca aparecem no GA4, PostHog ou Amplitude.

Os agentes de IA baseados em navegador têm o problema oposto. Operam em navegadores reais e geram dados de sessão que parecem de um humano. Portanto, o GA4 e outras ferramentas de análise contam-nos como utilizadores reais.

O que fazer quando deteta tráfego de agentes de IA

Não bloqueie por defeito

É tentador bloquear tudo o que parece automatizado, mas o bloqueio indiscriminado prejudica-o de duas formas. Perde visibilidade sobre o que está realmente a acontecer no seu site, e bloqueia agentes de consumidores que estão a tentar comprar os seus produtos ou recomendar a sua marca através de pesquisa de IA.

Estratégias de resposta adaptativa ao tráfego de agentes de IA

- Redirecionar ou servir conteúdo específico para agentes: Uma seguradora com quem trabalhamos descobriu bots a percorrer o seu fluxo de cotações para extrair preços. A solução: quando um bot era detetado no fluxo de cotação, o passo final mostrava um ecrã de "contacte-nos" em vez da cotação gerada. Nenhum dado de preço vazou para concorrentes/plataformas de agregação. No caso de um falso positivo, um humano podia continuar o processo de venda.

- Personalize a experiência. Em vez de bloquear um agente, dê-lhe uma vista construída para o efeito. Uma página que reconhece "identificámos que é um agente de IA, aqui está uma versão otimizada" permite que os agentes de consumidores obtenham a informação que precisam enquanto os seus visitantes humanos veem a experiência completa.

Temos um guia completo que cobre diferentes cenários de fraude aqui: Como bloquear agentes de IA fraudulentos no seu website.

Como a cside resolve a deteção de bots de IA e navegadores agênticos

A cside é uma plataforma de segurança web especializada em monitorizar o runtime do navegador. A deteção de agentes de IA da cside é construída especificamente para identificar agentes de IA fraudulentos no seu website. Com a cside:

- Obtenha um painel com os agentes que estão a aceder ao seu site e o que estão a fazer

- Pontuações de risco automáticas a partir de sinais comportamentais para apanhar agentes de IA maliciosos (incluindo baseados em navegador e alojados localmente) que contornam as defesas tradicionais de bots

- Alimente os sinais de deteção nos seus próprios fluxos de ação de enforcement

- Previna fraude de agentes de IA como abuso de códigos promocionais, pirataria de conteúdo, teste de cartões de crédito, descoberta de vulnerabilidades e scraping avançado