TL;DR

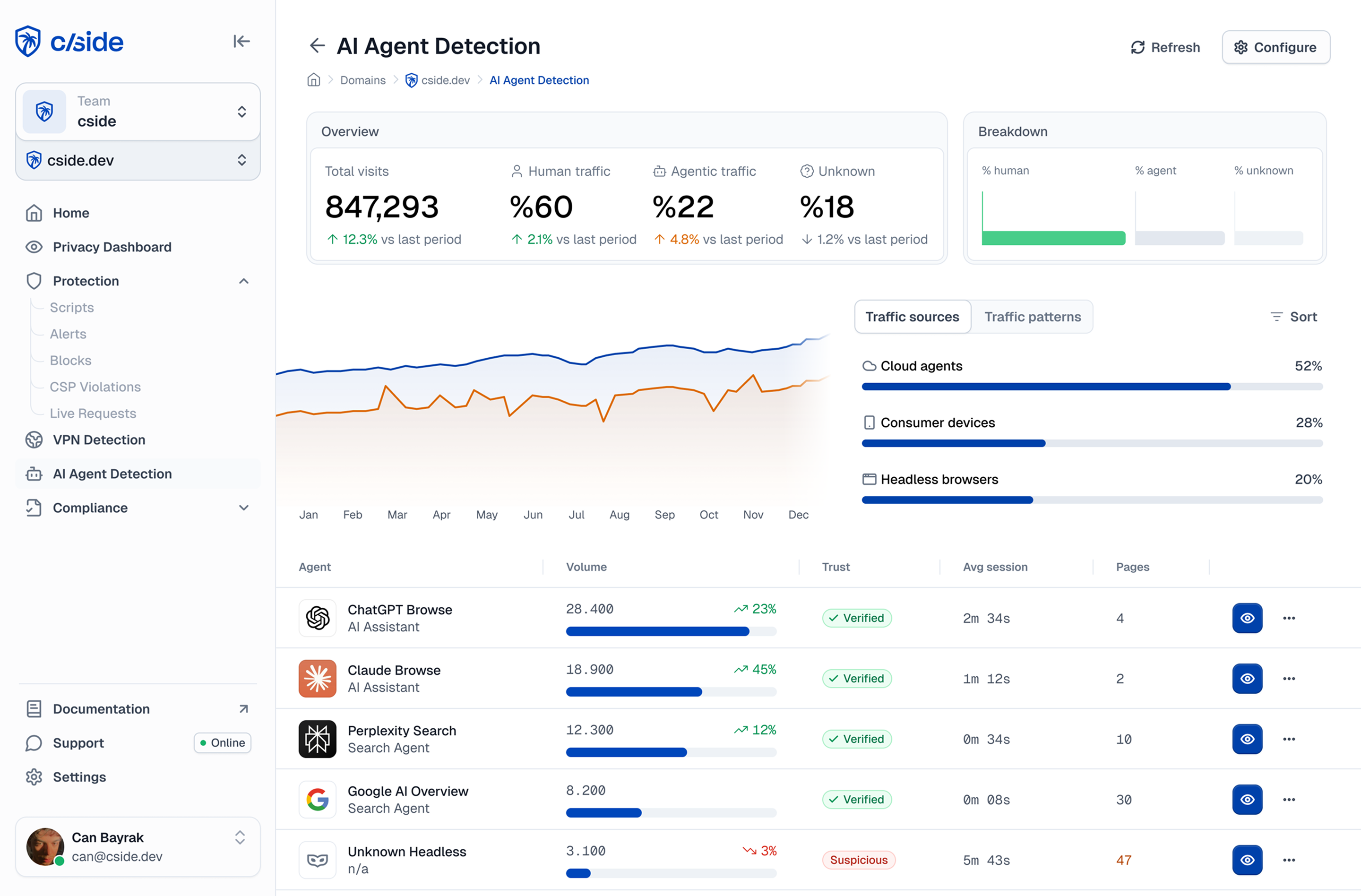

- Los métodos utilizados para identificar tráfico de agentes de IA son: analizar los logs del servidor, herramientas tradicionales de detección de bots (por ejemplo, Cloudflare o Akamai), o herramientas especializadas de detección de agentes de IA como cside.

- Las herramientas especializadas de detección de agentes de IA analizan cuatro categorías de señales: identidad, red, navegador y comportamiento.

- Las herramientas de analítica web como Google Analytics o PostHog generalmente no detectan el tráfico de agentes de IA o clasifican erróneamente a estos visitantes como humanos reales.

- Los agentes de IA relacionados con crawlers son más fáciles de identificar (con métodos DIY o herramientas gratuitas), pero detectar agentes 'anti-detect' diseñados para fines fraudulentos requiere un conjunto de herramientas completamente diferente.

- El 81% de las pruebas internas de cside lograron evadir la detección de bots de plataformas legacy con bots basados en agentes de IA.

3 métodos para detectar agentes de IA en tu sitio web

Tabla resumen: Detectando tráfico de agentes de IA en tu sitio web

| Logs del servidor | Detección especializada de agentes de IA | Detección tradicional de bots | Herramientas de analítica | |

|---|---|---|---|---|

| Qué detecta | Crawlers conocidos que se autoidentifican (GPTBot, ClaudeBot, etc.) | Agentes stealth, bots basados en navegador, agentes alojados localmente, automatización fraudulenta | Bots con scripts, IPs maliciosas conocidas, abuso básico de tasas | Anomalías de tráfico y patrones que indican actividad de bots |

| Profundidad de seguridad | No detecta agentes que falsifican su User-Agent o no se declaran | No tiene una cobertura 100% perfecta, pero es la opción más sólida en el panorama actual | Navegadores stealth, proxies residenciales, agentes alojados localmente | No puede distinguir sesiones de agentes de IA de las humanas |

| Cómo configurarlo | Revisa el panel de tu CDN (Cloudflare, Vercel) o analiza los logs de acceso de Nginx/Apache | Agrega un snippet de JS a tu sitio (similar a instalar analíticas) | Activa la protección contra bots en el panel de tu CDN; los niveles enterprise requieren contratos | Configura dimensiones personalizadas en GA4 o PostHog para detectar anomalías |

| Costo | Gratis | cside tiene planes Free, Small Business y Enterprise | Gratis (básico) a precios enterprise | Gratis |

| Ideal para | Un primer vistazo rápido a la actividad de crawlers conocidos | Detectar agentes fraudulentos | Bloquear bots genéricos y patrones maliciosos conocidos | Detectar que algo anda mal antes de saber qué es |

Desglosamos las señales específicas a buscar en las capas de red, navegador y comportamiento más adelante en este blog.

Método 1: Analizar los logs del servidor

- Cómo funciona: Cada vez que alguien (incluidos los bots) visita tu sitio web, tu servidor registra lo que declaró ser. Muchos bots de IA realmente te dicen su nombre. El bot de OpenAI dice "GPTBot", el de Anthropic dice "ClaudeBot". Para confirmar que un crawler es legítimo y no está falsificado, verifica la IP de la solicitud contra los rangos de IP oficialmente publicados del crawler.

- Cómo configurarlo: Si usas un CDN o plataforma de hosting, revisa sus paneles primero. Cloudflare, Vercel y Netlify ya tienen acceso a los logs de tu servidor y empaquetan esta información en un panel. Para sitios autoalojados, tu servidor web (Nginx, Apache) mantiene logs de acceso que puedes descargar o buscar con herramientas de línea de comandos.

- Limitaciones: Esto solo funciona con bots que eligen ser honestos. Tanto las cadenas user-agent como las defensas basadas en rangos de IP pueden ser fácilmente evadidas. Los bots que realmente son peligrosos no se anuncian. Y los agentes basados en navegador como Atlas de ChatGPT u OpenClaw tienen menos probabilidad de autoidentificarse a través de cadenas user-agent.

Método 2: Herramientas especializadas de detección de agentes de IA

Surgió una nueva categoría de herramientas de detección específicamente para abordar los agentes de IA, porque el problema va mucho más allá del scraping y el crawling. El 78% de los CTOs de instituciones financieras encuestados por Accenture esperan un aumento del fraude impulsado por agentes de compras de IA.

- Cómo funciona: Estas herramientas monitorean docenas de señales en 4 capas de detección: identidad (quién dice ser el visitante), red (desde dónde se conecta), entorno del navegador (cómo se ve su entorno de ejecución) y comportamiento (cómo interactúa realmente con la página). Al cruzar señales de las cuatro capas, pueden detectar agentes que pasan cualquier verificación individual por sí sola.

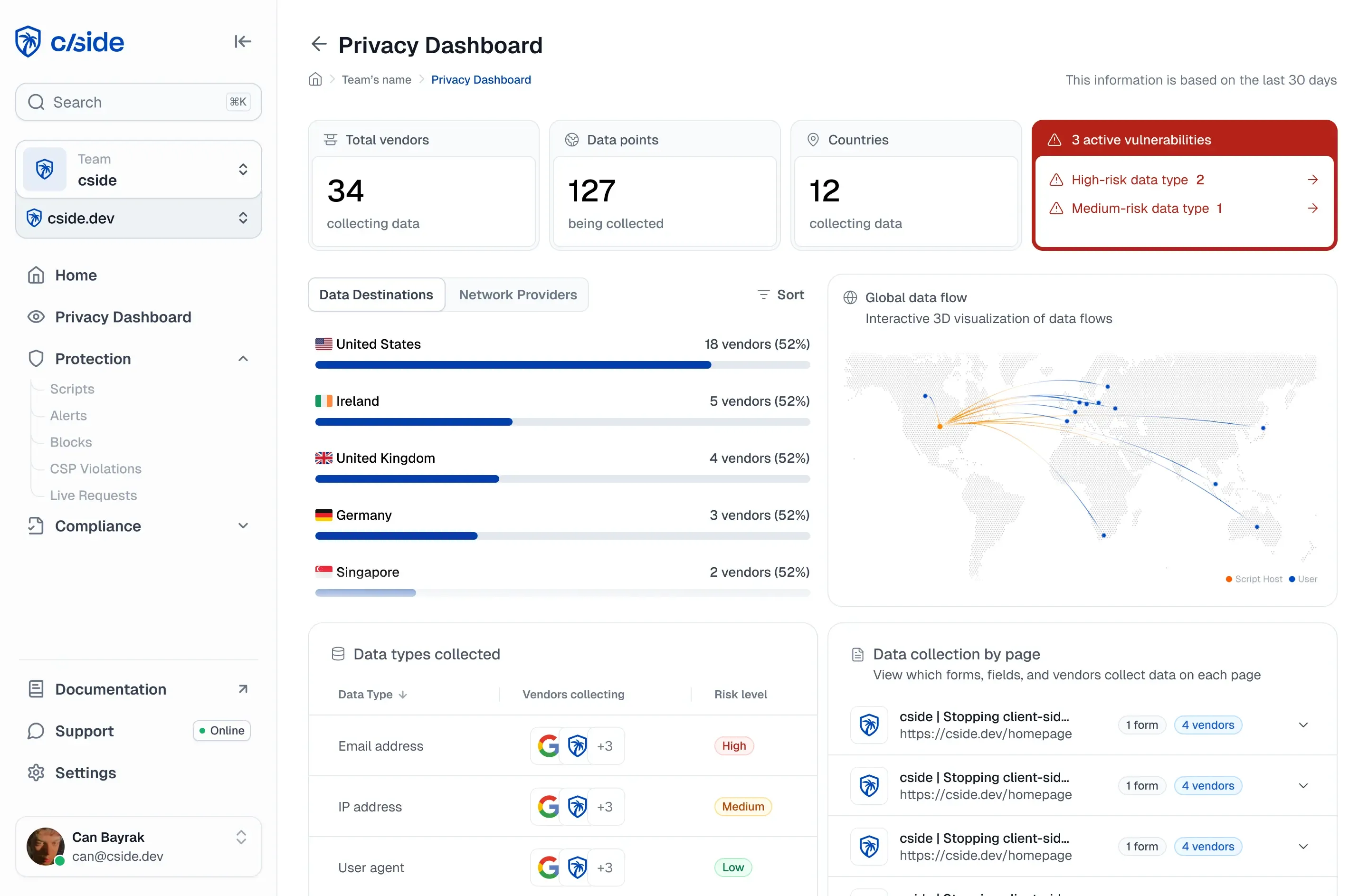

- Cómo configurarlo: La mayoría de estas herramientas (como cside) se instalan agregando un snippet de JavaScript a tu sitio, similar a cómo instalarías una herramienta de analítica. Una vez instalado, cside monitorea instantáneamente la actividad en las cuatro capas de señales y te muestra un panel de cuáles visitantes son humanos, cuáles son agentes conocidos y cuáles son sospechosos.

Desglosamos las señales que usamos para nuestra propia detección de agentes de IA más adelante en este blog.

Método 3: Herramientas tradicionales de detección de bots

Herramientas como Cloudflare Bot Fight Mode y Akamai Bot Manager fueron diseñadas para detectar tráfico automatizado. Son el punto de partida más común para la defensa contra bots, y muchos equipos ya las tienen implementadas.

- Cómo funcionan: Estas herramientas analizan las solicitudes entrantes usando una combinación de reputación de IP, huellas TLS (JA3/JA4), consistencia de encabezados y mecanismos de desafío-respuesta como CAPTCHAs.

- Cómo configurarlo: La mayoría de los proveedores de CDN ofrecen un toggle básico de protección contra bots en su panel. Otras plataformas dedicadas pueden requerir un snippet de JS o configuración de proxy reverso, además de una conversación contractual.

Limitaciones: Muchos proveedores de seguridad agregaron "detección de bots de IA" a sus páginas de productos en el último año sin cambiar adecuadamente cómo funciona su detección internamente. Las opciones de bajo costo o gratuitas para detección de agentes de IA dependen en gran medida de buscar patrones básicos de automatización o verificaciones tipo CAPTCHA, sin detectar muchos de los agentes maliciosos.

Algunos de nuestros ingenieros en cside realizaron una prueba desplegando bots basados en agentes de IA contra dos plataformas importantes de detección de bots, y evadimos la detección en 81 de 100 intentos.

Para ser justos, frecuentemente hay una diferencia enorme entre las funciones gratuitas/complementarias y los productos dedicados de gestión de bots enterprise de la misma empresa. Herramientas como Enterprise Bot Management de Cloudflare profundizan con señales de comportamiento. Pero también vienen con precios enterprise que la mayoría de las empresas no pueden justificar.

Muchas de las empresas con las que hablamos no se dan cuenta de cuánto tráfico malicioso permiten bajo la impresión de que activar un botón de "protección contra bots" de un proveedor de WAF es toda la defensa que necesitan.

Método adicional: Herramientas de analítica (Google Analytics, PostHog)

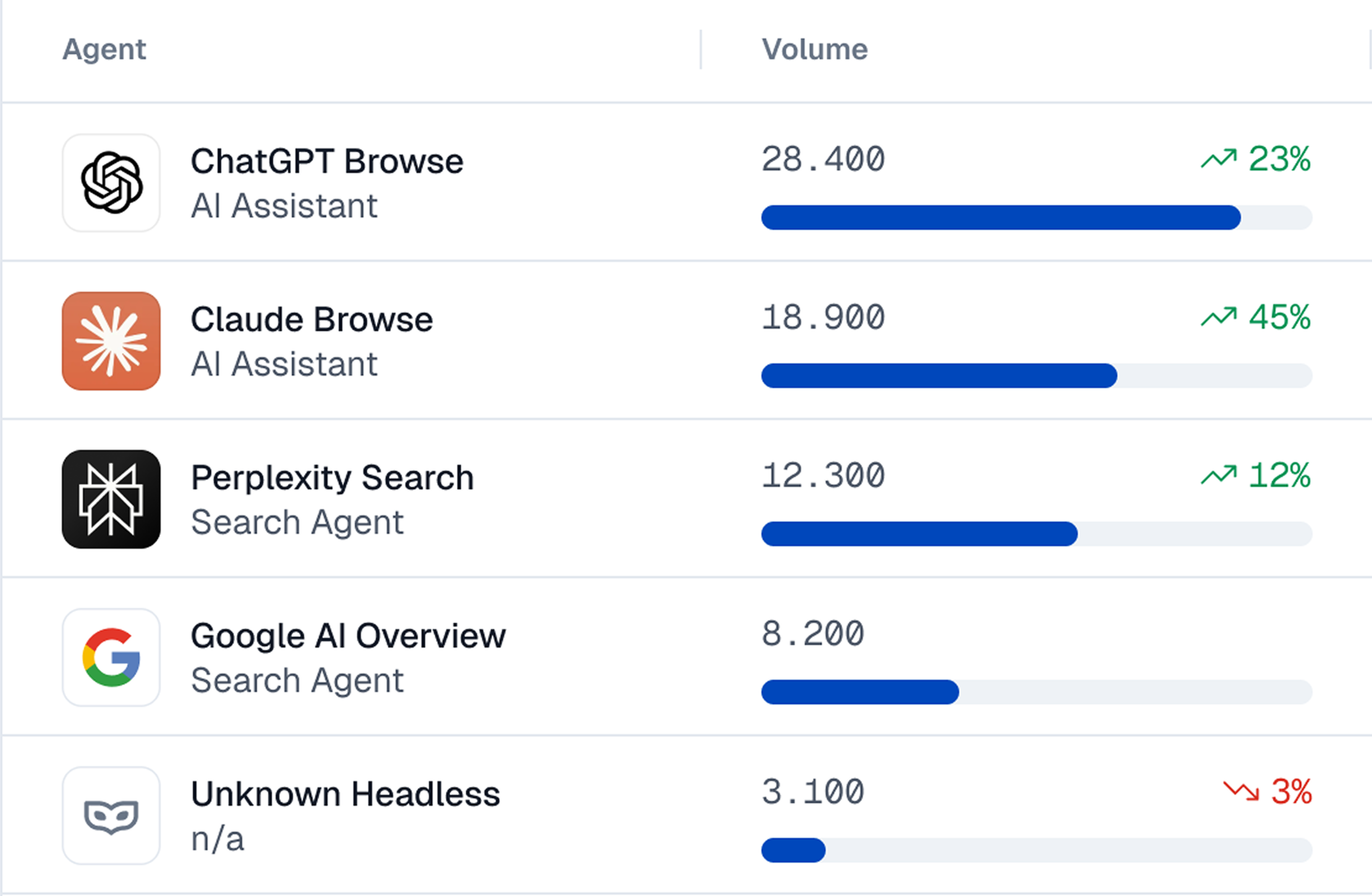

Notamos un pico desde China aunque ese país está geo-bloqueado en Cloudflare. Al investigar, este pico correlacionó con un aumento en el tráfico relacionado con "Chrome".

Google Analytics y PostHog no son herramientas de detección de bots. Pero queríamos incluirlos como una opción gratuita, instantánea (la mayoría de los sitios web ya usan estas herramientas) y sin código con la que puedes experimentar. Para ser claros, por defecto las herramientas de analítica como GA4 no detectarán el tráfico de agentes de IA y los categorizarán como "visitantes reales". No pueden distinguir entre un visitante real y un script de Playwright navegando tu sitio en Chrome headless.

Por eso nuestra investigación encontró un aumento del 275% en discusiones en foros sobre tráfico de bots que evadió los mecanismos de defensa habituales y apareció en Google Analytics.

Pero con parámetros personalizados puedes detectar algo de tráfico de navegadores agénticos:

- Un aumento del tráfico desde "Chrome" como navegador. La mayoría de los frameworks de automatización usan Chrome o "Chromium" por defecto.

- Sesiones desde países que ya has geo-bloqueado. Por ejemplo, nuestra configuración de Cloudflare bloqueó China pero GA4 sigue mostrando muchos picos de tráfico de esa región.

- Tráfico repentino desde ciudades específicas, frecuentemente ciudades chinas, que no tienen sentido para tu negocio.

- Un pico masivo de tráfico desde una resolución de pantalla particular (por ejemplo, 1270x980) y la misma área geográfica. Esto puede indicar una granja de bots que usa miles del mismo dispositivo.

- Un pico inexplicable desde un país aleatorio. Nosotros tuvimos que Noruega pasó de casi cero a más de 10,000 sesiones en un solo mes. Esto indica VPNs/proxies rotativos usados a escala por bots.

Los tipos de tráfico de agentes de IA en tu sitio web

Cuando la gente piensa en tráfico de agentes de IA, lo primero que viene a la mente son los crawlers. Los crawlers sí representan una gran parte del tráfico automatizado, pero son solo una categoría.

- Crawlers de búsqueda de IA: Agentes de motores de búsqueda impulsados por IA como Perplexity y Google AI Overviews. Visitan tu sitio para incluir contenido en resultados de búsqueda generados por IA.

- Crawlers de entrenamiento de LLMs: Bots como GPTBot, ClaudeBot y CCBot que extraen tu contenido para entrenar o actualizar modelos de lenguaje. La mayoría se declaran en sus cadenas User-Agent. Estos pueden ser problemáticos para sitios web con contenido que quieren proteger (arte, escritura, música) y no quieren que se use para entrenar LLMs.

- Scrapers: Específicamente, los que provienen de fuera de las principales plataformas de IA. Servicios de agregación que extraen tus datos hacia productos competidores, competidores monitoreando tus precios, u operaciones de piratería copiando tu contenido a escala.

- Agentes de acción del usuario (recuperación de información): Un consumidor le pide a ChatGPT que investigue tu producto o le dice a Claude que compare precios en tres proveedores. La plataforma envía un agente a tu sitio que navega páginas, lee contenido y trae la respuesta de vuelta.

- Agentes de acción del usuario (ejecución de tareas): Agentes desplegados por consumidores para cumplir tareas. Perplexity Comet completando una compra, una automatización de navegador descargando un PDF o llenando un formulario de contacto. Hacen clic en botones, envían formularios y navegan flujos como lo haría un humano.

- Agentes fraudulentos: Agentes construidos para propósitos explícitamente maliciosos. Por ejemplo, probar lotes de tarjetas de crédito robadas contra tu flujo de pago o crear docenas de cuentas para abusar de bonos de referidos. Estos son patrones de fraude conocidos, pero los agentes de IA los hacen más baratos de desplegar y más difíciles de detectar.

Los crawlers de búsqueda de IA y los crawlers de entrenamiento de LLMs pueden detectarse con métodos relativamente básicos. Si te preocupan los agentes fraudulentos, una herramienta especializada de detección de agentes de IA diseñada específicamente para la detección de fraude es una mejor opción.

Señales de detección de bots de IA que usamos en cside

| Capa de señal | Qué analiza |

|---|---|

| Identidad | Quién dice ser el visitante. Cadenas User-Agent, firmas de bots y verificaciones cruzadas contra listas de crawlers conocidos. |

| Red | De dónde proviene la solicitud. Reputación de IP, análisis de ASN (datacenter vs. residencial), huellas TLS (JA3/JA4) y consistencia geográfica entre la ubicación de la IP y la configuración del navegador. |

| Navegador/Dispositivo | Si el entorno del navegador es real. Artefactos de frameworks de automatización (trazas CDP), consistencia de APIs del navegador (WebGL, Canvas, Audio) y verificaciones de plausibilidad de hardware. |

| Comportamiento | Cómo interactúa realmente el visitante con la página. Velocidad de escritura, tiempo entre navegaciones, patrones de llenado de formularios, movimientos del ratón y ubicación de los clics. |

Señales de identidad

- La forma más directa de identificar un agente de IA es verificando quién dice ser. Para esto fue construido robots.txt. Crawlers como GPTBot, ClaudeBot y GoogleBot se identifican a través de cadenas User-Agent u otras firmas/identificadores de bots.

- En cside, mantenemos una lista de firmas de crawlers conocidos y verificamos los User-Agents entrantes contra ella, incluyendo crawlers agresivos o maliciosos reportados públicamente.

- La limitación es que las señales de identidad son fácilmente falsificables. Este sistema solo es confiable para bots que eligen autodeclararse. Según Ahrefs, hasta el 98% del tráfico de IA proviene de plataformas principales (OpenAI, Anthropic, Google, Meta) que generalmente pueden identificarse a través de señales de identidad.

Otros enfoques emergentes abordan el problema de identidad de los agentes de manera más seria. Por ejemplo, Browserbase, una plataforma que permite a los usuarios crear automatizaciones de navegador, emite un "pasaporte" de agente de IA que es una credencial verificada criptográficamente. Si esto se convierte en estándar de la industria entre las herramientas de automatización de navegadores, el filtrado de tráfico de IA sería más fácil para las organizaciones.

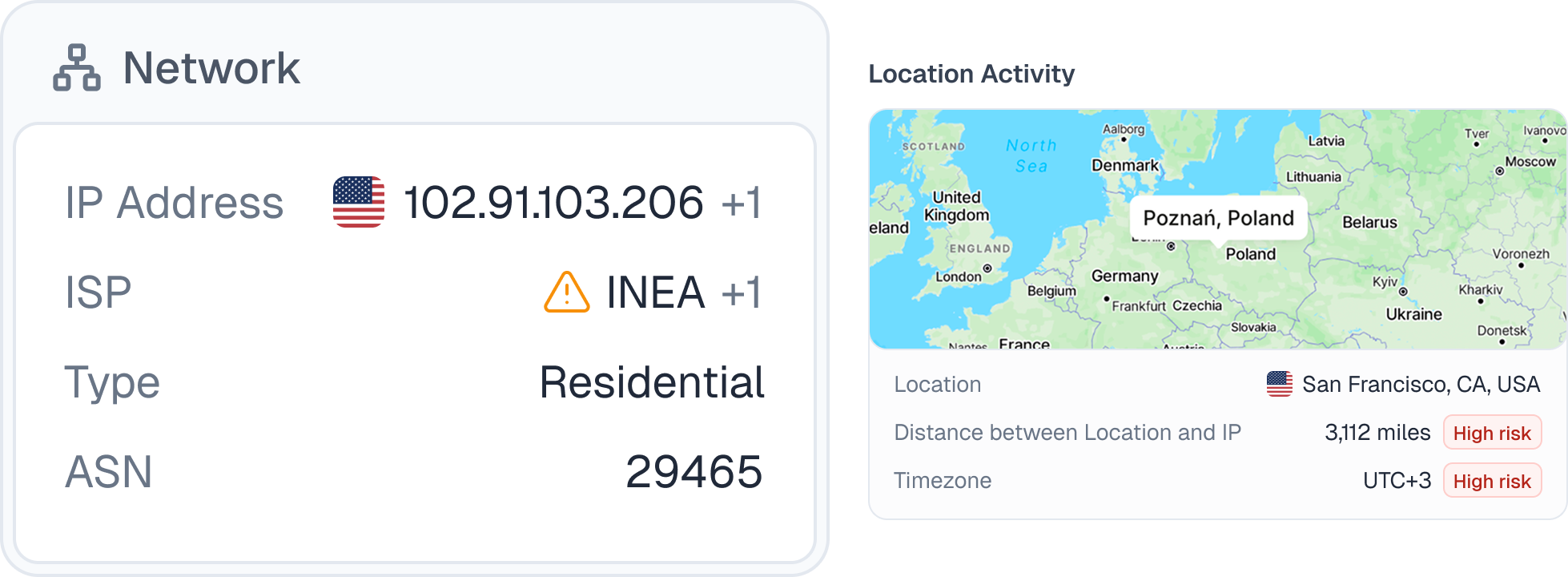

Señales de la capa de red

- Reputación de IP y análisis de ASN: Cada solicitud proviene de una dirección IP vinculada a un Número de Sistema Autónomo (ASN). Los ASN de datacenters (AWS, GCP, Azure) son un indicador fuerte de automatización. Las IPs residenciales son más difíciles de marcar, pero la verificación cruzada contra redes de proxies conocidas ayuda.

- Huellas TLS (JA3/JA4): Cuando un navegador se conecta a tu sitio, el handshake TLS crea una huella que identifica el software real del cliente. Si alguien dice ser Chrome pero su huella TLS se parece a un script de Python, has detectado una inconsistencia.

- Consistencia geográfica: Cruza la geolocalización de la IP con la zona horaria y la configuración de idioma del navegador. Si la IP resuelve a Frankfurt pero el navegador reporta una zona horaria de Asia/Shanghai y un idioma de zh-CN, algo no cuadra.

Señales de la capa de navegador/dispositivo

- Artefactos de frameworks de automatización. Playwright y Puppeteer usan el Chrome DevTools Protocol para controlar el navegador, y esto deja pistas. Algunos que buscamos son prefijos

cdc_en objetos del window o elementos de accesibilidad que han sido eliminados. - Consistencia de APIs del navegador: WebGL, Canvas y el contexto de Audio deberían contar una historia coherente sobre el dispositivo. Cuando un navegador reporta una GPU potente a través de WebGL pero produce una salida de Canvas que no coincide, o cuando la huella del contexto de Audio falta por completo, algo ha sido manipulado.

- Plausibilidad del hardware: La GPU declarada, la resolución de pantalla y el sistema operativo deben tener sentido juntos. Un visitante con una resolución móvil de 375x812 que reporta una GPU NVIDIA de escritorio en Linux no es un perfil de dispositivo real.

Señales de comportamiento

- El análisis de comportamiento se enfoca en cómo un visitante usa tu sitio. Velocidad de escritura, tiempo entre navegaciones de página, cómo se llenan los formularios, profundidad de scroll, patrones de movimiento del ratón. Incluso la automatización sofisticada tiende a producir patrones (o anomalías) que pueden identificarse.

- Esta capa requiere evolución constante. Los agentes se vuelven más inteligentes, y la señal de detección de ayer puede ser parcheada hoy. En cside, recopilamos continuamente datos de comportamiento y ejecutamos modelos de IA contra ellos para descubrir nuevos patrones a medida que cambia el comportamiento de los agentes.

La ubicación de los clics en botones es un ejemplo concreto. Uno de nuestros ingenieros, Martijn Cuppens, analizó tres herramientas populares basadas en extensiones de navegador:

- Una hacía clic en cada botón exactamente en el centro. Otra siempre hacía clic ligeramente descentrada hacia la derecha. La tercera centraba la mayoría de las veces pero ocasionalmente colocaba un clic en una posición aleatoria dentro del botón, un intento intencional de introducir ruido.

Esta es una de cientos de señales de comportamiento que recopilamos y analizamos. Cada una por sí sola puede no ser concluyente. Juntas, construyen un perfil que es muy difícil de falsificar.

Concepto erróneo: los agentes de IA solo usarán sitios web a través de APIs y MCP

Escucharás esto mucho: los sitios web migrarán a APIs y MCP y el navegador dejará de importar. Es una narrativa profética, pero no se sostiene y ciertamente no es el caso hoy:

- Google publicó una guía sobre cómo preparar tu sitio web para agentes, y cubre explícitamente la optimización de la interfaz visual. Los agentes interactúan a través del análisis del DOM y capturas de pantalla visuales. Si Google pensara que los sitios web se volverían solo APIs, no te estarían diciendo que hagas tus botones más claros y tus layouts más estables.

- Un estudio de investigadores de Carnegie Mellon encontró que los agentes híbridos que usan tanto navegación como llamadas a APIs superaron significativamente a las interacciones solo por API. Los agentes usaron ambas modalidades en el 77.7% de las tareas. Incluso con una buena API disponible, seguían recurriendo al navegador.

Por qué esto importa: los agentes navegan como humanos porque eso es lo que mejor funciona. Hacen clic, hacen scroll, llenan formularios y navegan página por página. Ese comportamiento es visible en la capa del navegador. No puedes observar una llamada a API de la misma manera que puedes observar a un agente trabajando a través de tu flujo de compra. El navegador es donde los detectas.

Por qué la detección de agentes de IA es diferente a la detección regular de bots

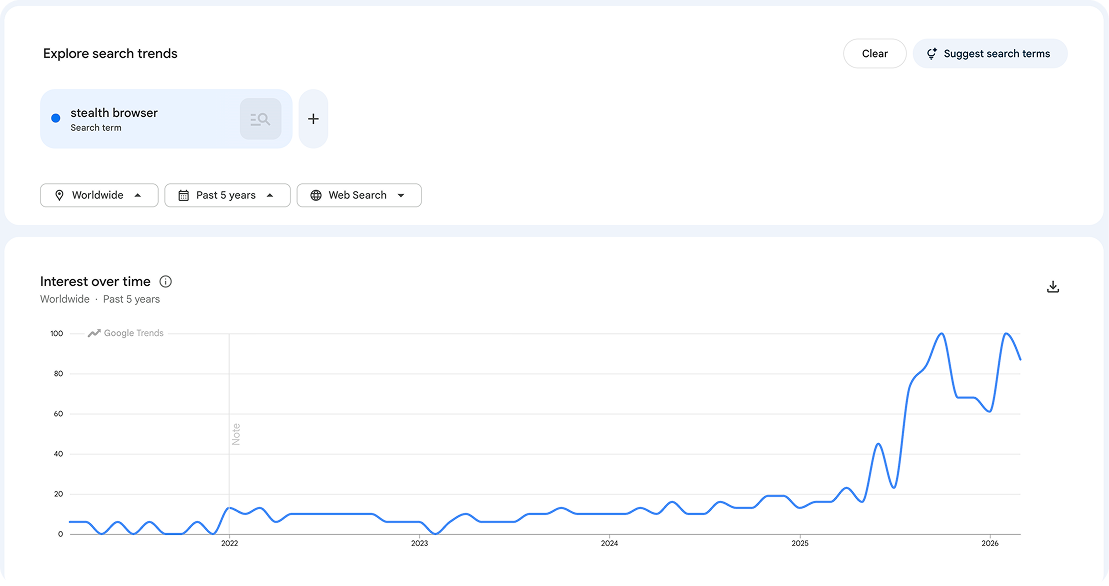

Navegadores stealth y frameworks anti-detect

- Hay toda una categoría de herramientas de automatización construidas específicamente para ser invisibles a la detección de bots, como Playwright con plugins stealth o browser-use. Suprimen el flag

navigator.webdriver, falsifican huellas de Canvas y WebGL, e intentan eliminar las trazas del Chrome DevTools Protocol que la mayoría de las herramientas de detección buscan. - Esto no es un rincón pequeño de internet. Las instalaciones npm de Playwright se triplicaron a más de 35 millones de descargas mensuales. Las búsquedas en Google de "stealth browser" pasaron de ser estables a máximos históricos continuos en los últimos dos años.

Automatización alojada localmente

Los bots tradicionales se ejecutaban en servidores en la nube (IPs de datacenters o máquinas virtuales). Los agentes de IA cada vez más se ejecutan en hardware real de consumidores. Alguien usando una extensión de navegador de Claude en su laptop personal envía solicitudes desde una IP residencial legítima, un navegador real y huellas de dispositivo auténticas.

Los atacantes pueden replicar este comportamiento ejecutando Playwright en dispositivos locales (Mac Minis por ejemplo) lo cual parece indistinguible de un consumidor usando un dispositivo.

De patrones con scripts a automatización basada en razonamiento

Los bots tradicionales seguían scripts. Paso uno, paso dos, paso tres. Esa previsibilidad es lo que los hacía detectables. Los agentes de IA ahora razonan sobre la página, deciden qué hacer después y se adaptan cuando algo inesperado sucede.

Los CAPTCHAs tampoco son un respaldo confiable ahora. Los modelos de visión de IA ahora resuelven CAPTCHAs más rápido y de manera más confiable que los humanos.

Cómo distinguir entre agentes de IA maliciosos y agentes de IA de consumidores

Hay un nuevo vector a considerar cuando se trata de detección de bots. Una parte del "tráfico de agentes de IA" proviene de consumidores que envían agentes a tu sitio.

- Perplexity Comet realiza compras en nombre de los usuarios. Amazon Buy for Me verifica inventario y completa pedidos. Base44 hace reservas. Estos son productos reales con adopción real de consumidores, no prototipos.

Como se cubre en nuestro informe de investigación sobre agentes de IA, el tráfico de bots de IA de "acción del usuario" aumentó más de 15 veces durante 2025. Bloquear toda la automatización ahora significa bloquear ingresos potenciales o al menos ralentizar la experiencia de compra.

De "bot o no" a clasificación por intención

Durante años, la detección de bots era binaria. ¿Es un bot? ¿Sí? Bloquéalo. Esto falla cuando tus propios clientes son quienes envían los bots. O cuando valoras la visibilidad de SEO/AEO que viene de los crawlers.

- El nuevo enfoque es la clasificación por intención: En lugar de preguntar "¿es un bot?", preguntas "¿qué está intentando hacer este bot?". La respuesta determina si lo permites, lo monitoreas, lo desafías o lo bloqueas.

Las señales alimentan un puntaje de riesgo. Si un visitante probó 17 tarjetas de crédito en tres minutos, eso es un ataque de enumeración de tarjetas. Si una sesión muestra señales de automatización y está creando múltiples cuentas en tu sitio, eso podría ser multi-accounting (múltiples cuentas para explotar pruebas gratuitas o bonos de registro). La detección de bots, el fingerprinting, y las señales de actividad de cuentas trabajan juntos para activar acciones de cumplimiento cuando la actividad automatizada se parece a actividad fraudulenta.

Por qué tus herramientas de analítica web no detectan el tráfico de agentes de IA

Los crawlers y scrapers de IA como GPTBot y ClaudeBot no ejecutan JavaScript en absoluto. Solicitan tu HTML, extraen el contenido y se van. Tu snippet de analíticas nunca se ejecuta, por lo que estas visitas nunca aparecen en GA4, PostHog o Amplitude.

Los agentes de IA basados en navegador tienen el problema opuesto. Operan en navegadores reales y generan datos de sesión que se parecen a los de un humano. Así que GA4 y otras herramientas de analítica los cuentan como usuarios reales.

Qué hacer cuando detectas tráfico de agentes de IA

No bloquees por defecto

Es tentador bloquear todo lo que parezca automatizado, pero el bloqueo indiscriminado te perjudica de dos maneras. Pierdes visibilidad sobre lo que realmente está pasando en tu sitio, y bloqueas agentes de consumidores que están intentando comprar tus productos o recomendar tu marca a través de búsqueda de IA.

Estrategias de respuesta adaptativa al tráfico de agentes de IA

- Redirige o sirve contenido específico para agentes: Una compañía de seguros con la que trabajamos descubrió bots recorriendo su flujo de cotización para extraer precios. Su solución: cuando se detectaba un bot en el flujo de cotización, el paso final mostraba una pantalla de "contáctanos" en lugar de la cotización generada. Ningún dato de precios se filtró a competidores/plataformas de agregación. En caso de un falso positivo, un humano aún podía continuar el proceso de venta.

- Personaliza la experiencia. En lugar de bloquear a un agente, dale una vista diseñada específicamente. Una página que reconoce "hemos identificado que eres un agente de IA, aquí tienes una versión optimizada" permite que los agentes de consumidores obtengan la información que necesitan mientras tus visitantes humanos ven la experiencia completa.

Tenemos una guía completa que cubre diferentes escenarios de fraude aquí: Cómo bloquear agentes de IA fraudulentos en tu sitio web.

Cómo cside resuelve la detección de bots de IA y navegadores agénticos

cside es una plataforma de seguridad web especializada en monitorear el runtime del navegador. La detección de agentes de IA de cside está diseñada específicamente para identificar agentes de IA fraudulentos en tu sitio web. Con cside:

- Obtén un panel de cuáles agentes están accediendo a tu sitio y qué están haciendo

- Puntajes de riesgo automáticos a partir de señales de comportamiento para detectar agentes de IA maliciosos (incluidos los basados en navegador y alojados localmente) que evaden las defensas tradicionales contra bots

- Alimenta las señales de detección en tus propios flujos de trabajo de acciones de cumplimiento

- Previene el fraude de agentes de IA como abuso de códigos promocionales, piratería de contenido, pruebas de tarjetas de crédito, descubrimiento de vulnerabilidades y scraping avanzado