TL;DR

- Les méthodes couramment utilisées pour identifier le trafic d'agents IA sont : l'analyse des logs serveur, les outils traditionnels de détection de bots (par ex. Cloudflare ou Akamai), ou les outils spécialisés de détection d'agents IA comme cside.

- Les outils spécialisés de détection d'agents IA examinent quatre catégories de signaux : identité, réseau, navigateur et comportement.

- Les outils d'analyse web comme Google Analytics ou PostHog passent généralement à côté du trafic d'agents IA ou classifient ces visiteurs comme de vrais humains.

- Les agents IA liés au crawling sont plus faciles à identifier (avec des méthodes DIY ou des outils gratuits), mais détecter les agents « anti-détection » conçus à des fins frauduleuses nécessite un ensemble d'outils totalement différent.

- 81 % des tests internes de cside ont réussi à contourner la détection de bots des plateformes traditionnelles avec des bots basés sur des agents IA.

3 méthodes pour détecter les agents IA sur votre site web

Tableau récapitulatif : Détecter le trafic d'agents IA sur votre site web

| Logs serveur | Détection spécialisée d'agents IA | Détection traditionnelle de bots | Outils d'analyse | |

|---|---|---|---|---|

| Ce qu'il détecte | Les crawlers connus qui s'identifient (GPTBot, ClaudeBot, etc.) | Agents furtifs, bots basés sur navigateur, agents hébergés localement, automatisation frauduleuse | Bots scriptés, adresses IP malveillantes connues, abus de débit basique | Anomalies de trafic et schémas indiquant une activité de bot |

| Profondeur de sécurité | Ne détecte pas les agents qui usurpent leur User-Agent ou ne se déclarent pas | Pas une couverture parfaite à 100 %, mais l'option la plus robuste dans le paysage actuel | Navigateurs furtifs, proxys résidentiels, agents hébergés localement | Ne peut pas distinguer les sessions d'agents IA des sessions humaines |

| Mise en place | Vérifiez le tableau de bord de votre CDN (Cloudflare, Vercel) ou analysez les logs d'accès Nginx/Apache | Ajoutez un snippet JS à votre site (similaire à l'installation d'un outil d'analyse) | Activez la protection anti-bots dans le tableau de bord de votre CDN ; les offres entreprise nécessitent un contrat | Configurez des dimensions personnalisées dans GA4 ou PostHog pour faire remonter les anomalies |

| Coût | Gratuit | cside propose des plans Gratuit, Petite Entreprise et Entreprise | Gratuit (basique) à tarification entreprise | Gratuit |

| Idéal pour | Un premier aperçu rapide de l'activité des crawlers connus | Détecter les agents frauduleux | Bloquer les bots courants et les schémas malveillants connus | Repérer qu'un problème existe avant de savoir de quoi il s'agit |

Nous détaillons les signaux spécifiques à surveiller aux niveaux réseau, navigateur et comportemental plus loin dans cet article.

Méthode 1 : Analyser les logs serveur

- Comment ça fonctionne : Chaque fois que quelqu'un (y compris les bots) visite votre site web, votre serveur enregistre ce qu'il prétend être. De nombreux bots IA vous communiquent leur nom. Le bot d'OpenAI indique « GPTBot », celui d'Anthropic indique « ClaudeBot ». Pour confirmer qu'un crawler est légitime et non usurpé, recoupez l'IP de la requête avec les plages IP officiellement publiées par le crawler.

- Comment le mettre en place : Si vous utilisez un CDN ou une plateforme d'hébergement, vérifiez d'abord leurs tableaux de bord. Cloudflare, Vercel et Netlify ont déjà accès à vos logs serveur et présentent ces informations dans un tableau de bord. Pour les sites auto-hébergés, votre serveur web (Nginx, Apache) conserve des logs d'accès que vous pouvez télécharger ou rechercher avec des outils en ligne de commande.

- Limites : Cela ne fonctionne qu'avec les bots qui choisissent d'être honnêtes. Les défenses basées sur les chaînes user-agent et les plages IP peuvent être facilement contournées. Les bots réellement dangereux ne s'annoncent pas. Et les agents basés sur navigateur comme Atlas de ChatGPT ou OpenClaw sont moins susceptibles de s'identifier via les chaînes user-agent.

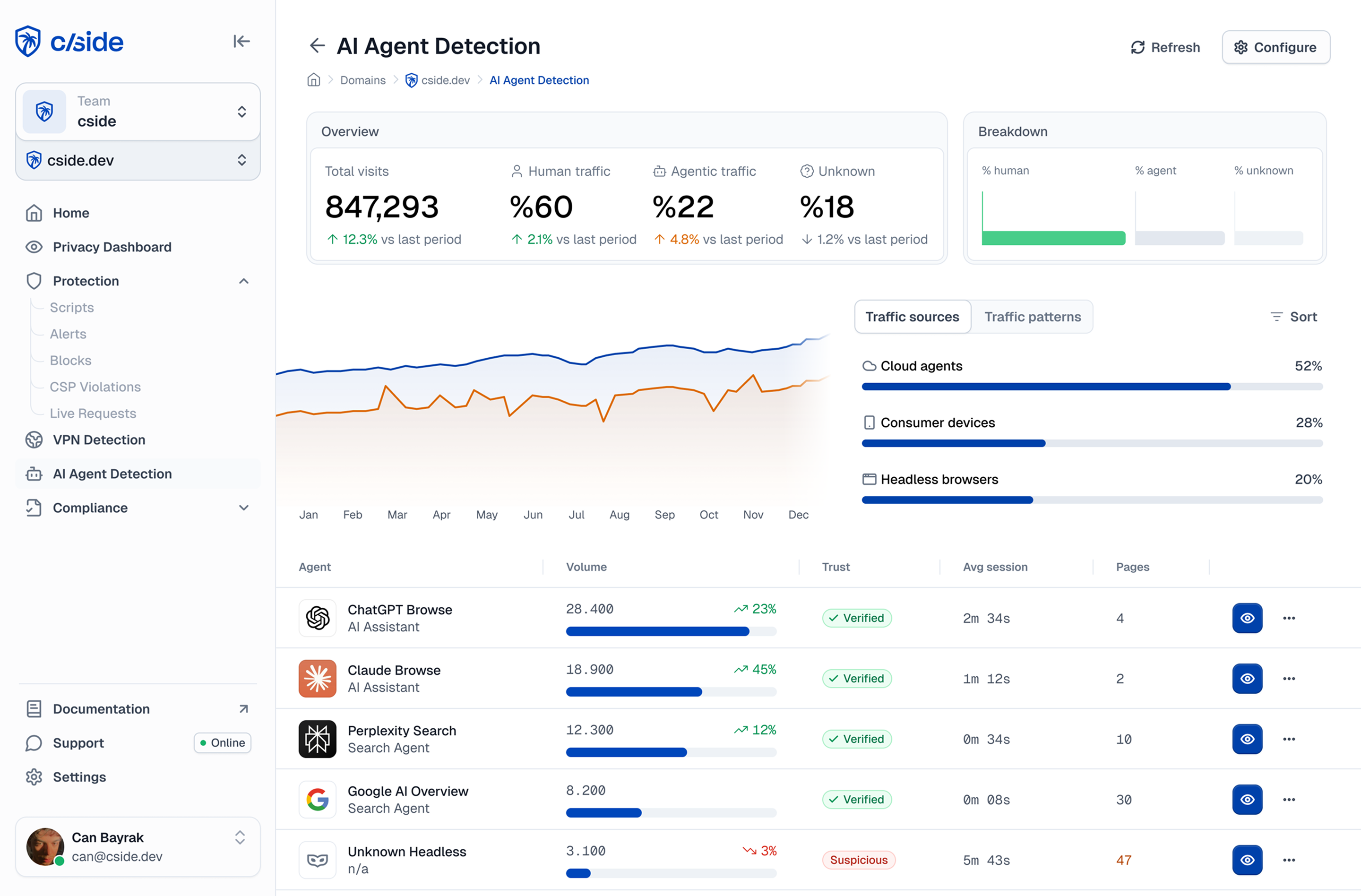

Méthode 2 : Outils spécialisés de détection d'agents IA

Une nouvelle catégorie d'outils de détection a émergé spécifiquement pour répondre au problème des agents IA, car le problème va bien au-delà du scraping et du crawling. 78 % des directeurs techniques d'institutions financières interrogés par Accenture s'attendent à une hausse de la fraude liée aux agents IA d'achat.

- Comment ça fonctionne : Ces outils surveillent des dizaines de signaux à travers 4 couches de détection : identité (qui le visiteur prétend être), réseau (d'où il se connecte), environnement du navigateur (à quoi ressemble son environnement d'exécution) et comportement (comment il interagit réellement avec la page). En recoupant les signaux des quatre couches, ils peuvent détecter des agents qui passeraient n'importe quel contrôle individuel pris séparément.

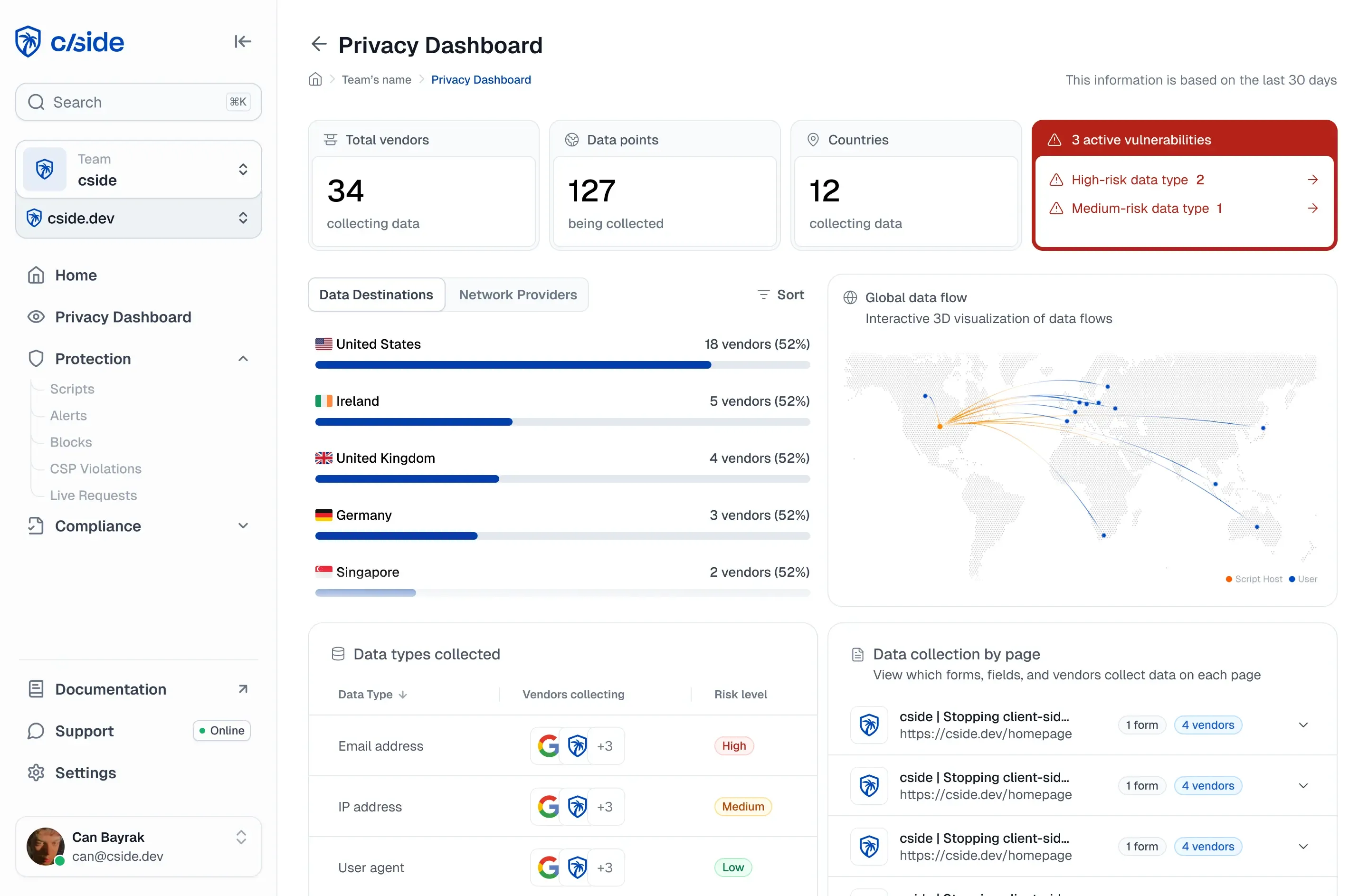

- Comment le mettre en place : La plupart de ces outils (comme cside) s'installent en ajoutant un snippet JavaScript à votre site, de la même manière que vous installeriez un outil d'analyse. Une fois cside installé, il surveille instantanément l'activité à travers les quatre couches de signaux et vous présente un tableau de bord indiquant quels visiteurs sont humains, lesquels sont des agents connus et lesquels sont suspects.

Nous détaillons les signaux que nous utilisons pour notre propre détection d'agents IA plus loin dans cet article.

Méthode 3 : Outils traditionnels de détection de bots

Des outils comme Cloudflare Bot Fight Mode et Akamai Bot Manager ont été conçus pour détecter le trafic automatisé. Ils constituent le point de départ le plus courant pour la défense anti-bots, et beaucoup d'équipes les ont déjà en place.

- Comment ils fonctionnent : Ces outils analysent les requêtes entrantes en combinant la réputation IP, les empreintes TLS (JA3/JA4), la cohérence des en-têtes et des mécanismes de défi-réponse comme les CAPTCHA.

- Comment le mettre en place : La plupart des fournisseurs de CDN proposent un bouton basique de protection anti-bots dans leur tableau de bord. D'autres plateformes dédiées peuvent nécessiter un snippet JS ou une configuration de reverse proxy, plus une négociation contractuelle.

Limites : De nombreux fournisseurs de sécurité ont ajouté « détection de bots IA » sur leurs pages produit au cours de la dernière année sans modifier adéquatement le fonctionnement réel de leur détection. Les modules complémentaires gratuits ou à faible coût pour la détection d'agents IA reposent largement sur la recherche de schémas d'automatisation basiques ou de vérifications de type CAPTCHA, en passant à côté de nombreux agents malveillants.

Certains de nos ingénieurs chez cside ont mené un test en déployant des bots basés sur des agents IA contre deux grandes plateformes de détection de bots, et nous avons contourné la détection dans 81 tentatives sur 100.

Pour être honnête, il existe souvent une différence considérable entre les fonctionnalités gratuites/complémentaires et les produits dédiés de gestion de bots en version entreprise de la même société. Des outils comme l'Enterprise Bot Management de Cloudflare vont plus loin avec des signaux comportementaux. Mais ils s'accompagnent aussi d'une tarification entreprise que la plupart des sociétés ne peuvent pas justifier.

Beaucoup d'entreprises à qui nous parlons ne réalisent pas la quantité de trafic malveillant qu'elles laissent passer en pensant qu'activer un bouton « protection anti-bots » depuis un fournisseur WAF suffit comme défense.

Méthode bonus : Outils d'analyse (Google Analytics, PostHog)

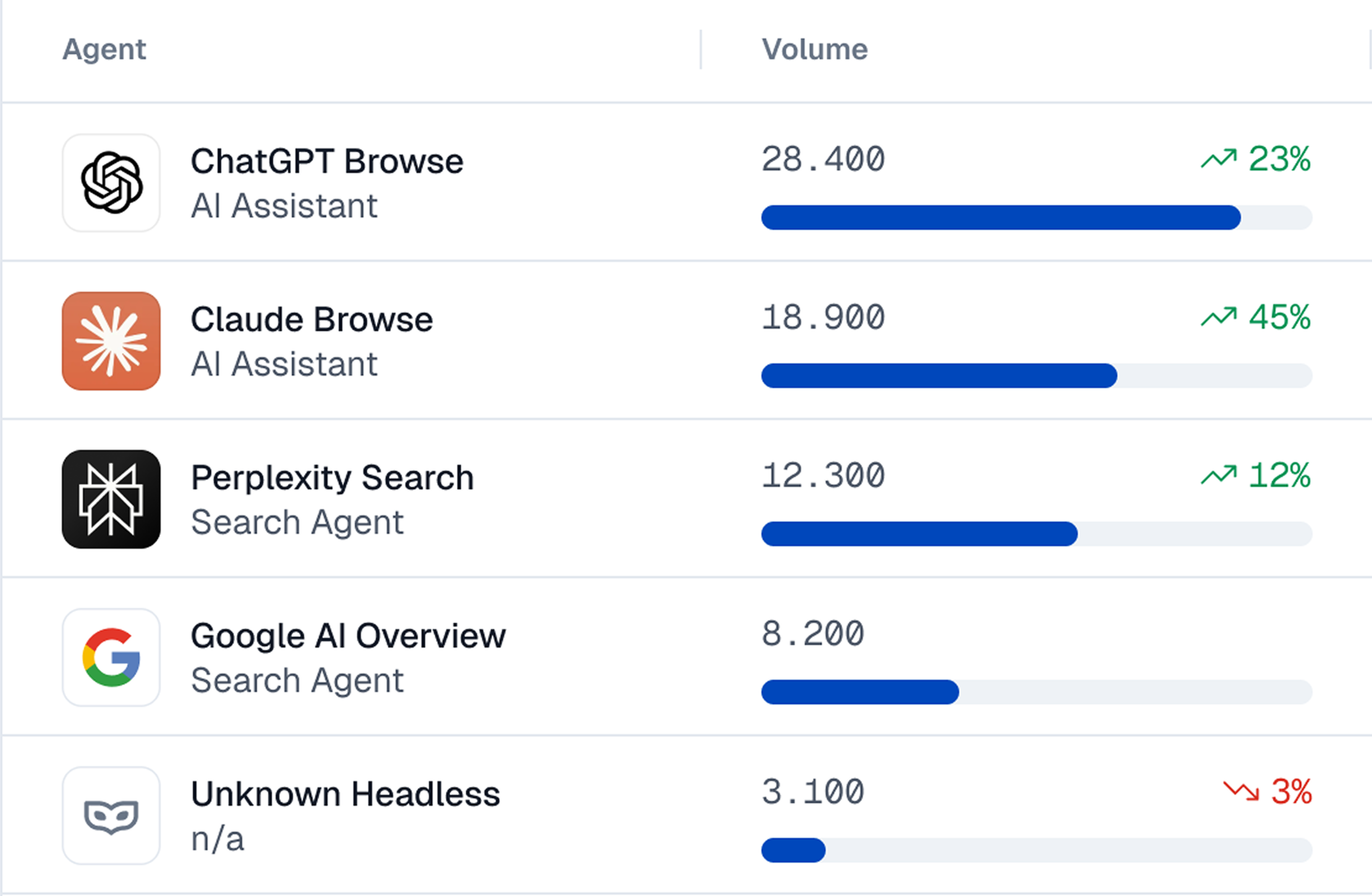

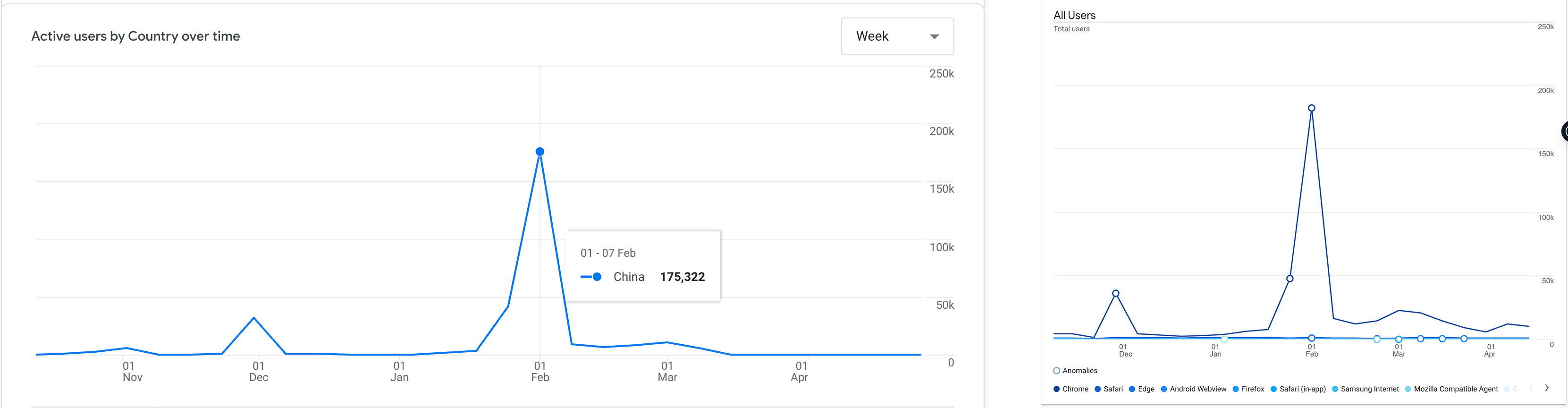

Nous avons remarqué un pic en provenance de Chine alors que ce pays est géo-bloqué dans Cloudflare. En examinant les données, ce pic était corrélé à une hausse du trafic lié à « Chrome ».

Google Analytics et PostHog ne sont pas des outils de détection de bots. Mais nous voulions les inclure comme option gratuite, immédiate (la plupart des sites web utilisent déjà ces outils) et sans code que vous pouvez exploiter. Soyons clairs : par défaut, les outils d'analyse comme GA4 passent à côté du trafic d'agents IA et les catégorisent comme de « vrais visiteurs ». Ils ne peuvent pas distinguer un vrai visiteur d'un script Playwright naviguant sur votre site dans Chrome en mode headless.

C'est pourquoi nos recherches ont révélé une hausse de 275 % des discussions sur les forums à propos du trafic de bots qui contournait les mécanismes de défense habituels et apparaissait dans Google Analytics.

Mais avec des paramètres personnalisés, vous pouvez détecter une partie du trafic de navigateurs agentiques :

- Une hausse du trafic provenant de « Chrome » comme navigateur. La plupart des frameworks d'automatisation utilisent Chrome ou « Chromium » par défaut.

- Des sessions en provenance de pays que vous avez déjà géo-bloqués. Par exemple, notre configuration Cloudflare bloquait la Chine mais GA4 montre toujours de nombreux pics de trafic depuis cette région.

- Du trafic soudain depuis des villes spécifiques, souvent des villes chinoises, qui n'ont aucun sens pour votre activité.

- Un pic massif de trafic depuis une résolution d'écran particulière (par ex. 1270x980) et la même zone géographique. Cela peut indiquer une ferme de bots utilisant des milliers d'appareils identiques.

- Un pic inexplicable depuis un pays aléatoire. Nous avons vu la Norvège passer de presque zéro à plus de 10 000 sessions en un seul mois. Cela indique des VPN/proxys rotatifs utilisés à grande échelle par des bots.

Les types de trafic d'agents IA sur votre site web

Quand les gens pensent au trafic d'agents IA, la première chose qui vient à l'esprit, ce sont les crawlers. Les crawlers représentent effectivement une grande partie du trafic automatisé, mais ils ne sont qu'une catégorie parmi d'autres.

- Crawlers de recherche IA : Agents provenant de moteurs de recherche alimentés par l'IA comme Perplexity et Google AI Overviews. Ils visitent votre site pour intégrer votre contenu dans des résultats de recherche générés par l'IA.

- Crawlers d'entraînement de LLM : Des bots comme GPTBot, ClaudeBot et CCBot qui récupèrent votre contenu pour entraîner ou mettre à jour de grands modèles de langage. La plupart s'identifient dans leurs chaînes User-Agent. Ils peuvent poser problème pour les sites web dont le contenu est protégé (œuvres artistiques, textes, musique) et ne devrait pas servir à entraîner des LLM.

- Scrapers : Plus précisément, ceux qui proviennent de l'extérieur des grandes plateformes IA. Des services d'agrégation qui aspirent vos données vers des produits concurrents, des concurrents qui surveillent vos prix, ou des opérations de piratage qui copient votre contenu à grande échelle.

- Agents d'action utilisateur (recherche d'information) : Un consommateur demande à ChatGPT de faire des recherches sur votre produit ou dit à Claude de comparer les prix chez trois fournisseurs. La plateforme envoie un agent sur votre site qui parcourt les pages, lit le contenu et rapporte la réponse.

- Agents d'action utilisateur (exécution de tâches) : Des agents déployés par les consommateurs pour accomplir des tâches. Perplexity Comet qui effectue un achat, une automatisation de navigateur qui télécharge un PDF ou remplit un formulaire de contact. Ils cliquent sur des boutons, soumettent des formulaires et parcourent les flux exactement comme le ferait un humain.

- Agents frauduleux : Des agents conçus à des fins explicitement malveillantes. Par exemple : tester des lots de cartes de crédit volées sur votre tunnel de paiement ou créer des dizaines de comptes pour abuser des bonus de parrainage. Ce sont des schémas de fraude familiers, mais les agents IA les rendent moins coûteux à déployer et plus difficiles à détecter.

Les crawlers de recherche IA et les crawlers d'entraînement de LLM peuvent être détectés avec des méthodes relativement basiques. Si vous êtes préoccupé par les agents frauduleux, un outil spécialisé de détection d'agents IA conçu spécifiquement pour la détection de fraude est une meilleure option.

Signaux de détection de bots IA que nous utilisons chez cside

| Couche de signal | Ce qu'elle examine |

|---|---|

| Identité | Qui le visiteur prétend être. Chaînes User-Agent, signatures de bots et recoupements avec les listes de crawlers connus. |

| Réseau | D'où vient la requête. Réputation IP, analyse ASN (datacenter vs. résidentiel), empreinte TLS (JA3/JA4) et cohérence géographique entre la localisation IP et les paramètres du navigateur. |

| Navigateur/Appareil | Si l'environnement du navigateur est authentique. Artefacts de frameworks d'automatisation (traces CDP), cohérence des API du navigateur (WebGL, Canvas, Audio) et contrôles de plausibilité matérielle. |

| Comportemental | Comment le visiteur interagit réellement avec la page. Vitesse de frappe, temps entre les navigations, schémas de remplissage de formulaires, mouvements de souris et emplacement des clics. |

Signaux d'identité

- La manière la plus directe d'identifier un agent IA est de vérifier qui il prétend être. C'est pour cela que robots.txt a été conçu. Des crawlers comme GPTBot, ClaudeBot et GoogleBot s'identifient via les chaînes User-Agent ou d'autres signatures/identifiants de bot.

- Chez cside, nous maintenons une liste de signatures de crawlers connues et recoupons les User-Agents entrants avec cette liste, y compris les crawlers signalés publiquement comme agressifs ou malveillants.

- La limite est que les signaux d'identité sont facilement falsifiables. Ce système n'est fiable que pour les bots qui choisissent de se déclarer. Selon Ahrefs, jusqu'à 98 % du trafic IA provient des grandes plateformes (OpenAI, Anthropic, Google, Meta) qui peuvent généralement être identifiées grâce aux signaux d'identité.

D'autres approches émergentes abordent le problème d'identité des agents de manière plus sérieuse. Par exemple, Browserbase, une plateforme qui permet aux utilisateurs de créer des automatisations de navigateur, délivre un « passeport » d'agent IA sous forme d'identifiant vérifié cryptographiquement. Si cela devient un standard industriel à travers les outils d'automatisation de navigateur, le filtrage du trafic IA deviendrait plus facile pour les organisations.

Signaux de la couche réseau

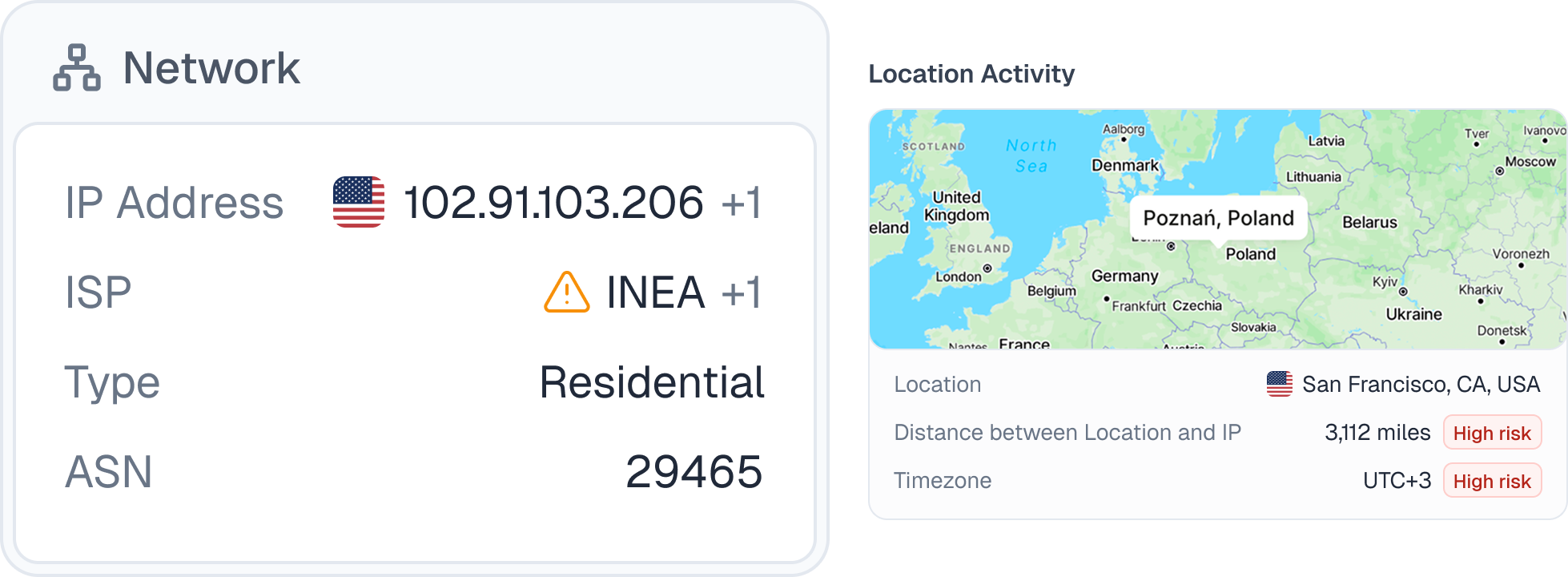

- Réputation IP et analyse ASN : Chaque requête provient d'une adresse IP liée à un numéro de système autonome (ASN). Les ASN de datacenters (AWS, GCP, Azure) sont un indicateur fort d'automatisation. Les IP résidentielles sont plus difficiles à signaler, mais le recoupement avec les réseaux de proxys connus aide.

- Empreinte TLS (JA3/JA4) : Quand un navigateur se connecte à votre site, le handshake TLS crée une empreinte qui identifie le véritable logiciel client. Si quelqu'un prétend être Chrome mais que son empreinte TLS ressemble à un script Python, vous avez repéré une incohérence.

- Cohérence géographique : Recoupez la géolocalisation IP avec le fuseau horaire et les paramètres de langue du navigateur. Si l'IP pointe vers Francfort mais que le navigateur indique un fuseau horaire Asia/Shanghai et une langue zh-CN, quelque chose ne colle pas.

Signaux de la couche navigateur/appareil

- Artefacts de frameworks d'automatisation. Playwright et Puppeteer utilisent le Chrome DevTools Protocol pour contrôler le navigateur, ce qui laisse des traces. Parmi celles que nous recherchons : les préfixes

cdc_dans les objets window ou les éléments d'accessibilité qui ont été supprimés. - Cohérence des API du navigateur : WebGL, Canvas et le contexte Audio doivent raconter une histoire cohérente à propos de l'appareil. Quand un navigateur signale un GPU puissant via WebGL mais produit une sortie Canvas qui ne correspond pas, ou quand l'empreinte du contexte Audio est totalement absente, quelque chose a été altéré.

- Plausibilité matérielle : Le GPU déclaré, la résolution d'écran et le système d'exploitation doivent être cohérents entre eux. Un visiteur avec une résolution mobile de 375x812 signalant un GPU NVIDIA de bureau sous Linux n'est pas un profil d'appareil réel.

Signaux comportementaux

- L'analyse comportementale se concentre sur la manière dont un visiteur utilise votre site. Vitesse de frappe, temps entre les navigations de page, comment les formulaires sont remplis, profondeur de défilement, schémas de mouvement de la souris. Même une automatisation sophistiquée tend à produire des schémas (ou des anomalies) qui peuvent être identifiés.

- Cette couche nécessite une évolution constante. Les agents deviennent plus intelligents, et le signal de détection d'hier peut être corrigé aujourd'hui. Chez cside, nous collectons en continu des données comportementales et exécutons des modèles IA pour faire émerger de nouveaux schémas à mesure que le comportement des agents évolue.

L'emplacement des clics sur les boutons est un exemple concret. L'un de nos ingénieurs, Martijn Cuppens, a analysé trois outils populaires basés sur des extensions de navigateur :

- L'un cliquait sur chaque bouton exactement au centre. Un autre cliquait systématiquement légèrement à droite du centre. Le troisième centrait la plupart du temps mais plaçait occasionnellement un clic à une position aléatoire dans le bouton, une tentative intentionnelle d'introduire du bruit.

C'est l'un des centaines de signaux comportementaux que nous collectons et analysons. Chacun pris isolément peut ne pas être concluant. Ensemble, ils construisent un profil très difficile à contrefaire.

Idée reçue : les agents IA n'utiliseront les sites web qu'à travers des API et MCP

On entend souvent ceci : les sites web vont basculer vers des API et MCP et le navigateur n'aura plus d'importance. C'est un discours prophétique, mais il ne tient pas et ce n'est certainement pas le cas aujourd'hui :

- Google a publié un guide pour rendre votre site web « agent-ready », et il couvre explicitement l'optimisation visuelle de l'interface. Les agents interagissent via l'analyse du DOM et des captures d'écran visuelles. Si Google pensait que les sites web allaient devenir uniquement API, ils ne vous diraient pas de rendre vos boutons plus clairs et vos mises en page plus stables.

- Une étude de chercheurs de Carnegie Mellon a montré que les agents hybrides utilisant à la fois la navigation et les appels API surpassaient significativement les interactions uniquement API. Les agents utilisaient les deux modalités dans 77,7 % des tâches. Même avec une bonne API disponible, ils revenaient quand même au navigateur.

Pourquoi c'est important : les agents naviguent comme des humains parce que c'est ce qui fonctionne le mieux. Ils cliquent, défilent, remplissent des formulaires et naviguent page par page. Ce comportement est visible au niveau du navigateur. Vous ne pouvez pas observer un appel API de la même manière que vous pouvez observer un agent qui parcourt votre tunnel d'achat. Le navigateur est l'endroit où vous les détectez.

Pourquoi la détection d'agents IA est différente de la détection classique de bots

Navigateurs furtifs et frameworks anti-détection

- Il existe toute une catégorie d'outils d'automatisation construits spécifiquement pour être invisibles face à la détection de bots, comme Playwright avec des plugins furtifs ou browser-use. Ils suppriment le flag

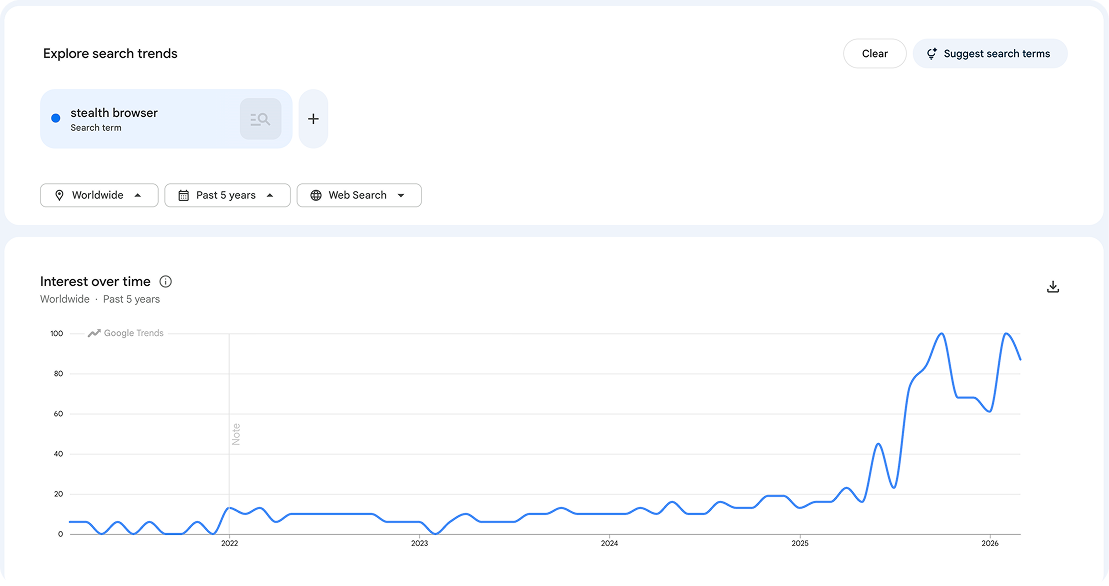

navigator.webdriver, falsifient les empreintes Canvas et WebGL, et tentent d'éliminer les traces du Chrome DevTools Protocol que la plupart des outils de détection recherchent. - Ce n'est pas un petit recoin d'internet. Les installations npm de Playwright ont triplé pour dépasser 35 millions de téléchargements mensuels. Les recherches Google pour « stealth browser » sont passées d'un niveau stable à des records historiques continus au cours des deux dernières années.

Automatisation hébergée localement

Les bots traditionnels fonctionnaient sur des serveurs cloud (adresses IP de datacenters ou machines virtuelles). Les agents IA fonctionnent de plus en plus sur du matériel grand public réel. Quelqu'un utilisant une extension de navigateur Claude sur son ordinateur portable personnel envoie des requêtes depuis une IP résidentielle légitime, un vrai navigateur et des empreintes d'appareil authentiques.

Les attaquants peuvent reproduire ce comportement en exécutant Playwright sur des appareils locaux (des Mac Mini par exemple) ce qui semble indiscernable d'un consommateur utilisant un appareil.

Des schémas scriptés à l'automatisation basée sur le raisonnement

Les bots traditionnels suivaient des scripts. Étape un, étape deux, étape trois. Cette prévisibilité est ce qui les rendait détectables. Les agents IA raisonnent désormais sur la page, décident de la prochaine action et s'adaptent quand quelque chose d'inattendu se produit.

Les CAPTCHA ne sont plus non plus un filet de sécurité fiable. Les modèles de vision IA résolvent désormais les CAPTCHA plus rapidement et plus efficacement que les humains.

Comment distinguer les agents IA malveillants des agents IA grand public

Il y a un nouveau vecteur à considérer en matière de détection de bots. Une partie du « trafic d'agents IA » provient de consommateurs qui envoient des agents sur votre site.

- Perplexity Comet effectue des achats au nom des utilisateurs. Amazon Buy for Me vérifie les stocks et finalise les commandes. Base44 réserve des hébergements. Ce sont de vrais produits avec une adoption réelle par les consommateurs, pas des prototypes.

Comme indiqué dans notre rapport de recherche sur les agents IA, le trafic de bots IA de type « action utilisateur » a augmenté de plus de 15x au cours de 2025. Bloquer toute automatisation revient désormais à bloquer du chiffre d'affaires potentiel ou au minimum à ralentir l'expérience d'achat.

De « bot ou non » à la classification d'intention

Pendant des années, la détection de bots était binaire. Est-ce un bot ? Oui ? Bloquez-le. Cela ne fonctionne plus quand ce sont vos clients qui envoient les bots. Ou quand vous valorisez la visibilité SEO/AEO apportée par les crawlers.

- La nouvelle approche est la classification d'intention : Au lieu de demander « est-ce un bot », vous demandez « que cherche ce bot à faire ? » La réponse détermine si vous l'autorisez, le surveillez, le contestez ou le bloquez.

Les signaux alimentent un score de risque. Si un visiteur a testé 17 cartes de crédit en trois minutes, c'est une attaque par énumération de cartes. Si une session présente des signaux d'automatisation et crée de multiples comptes sur votre site, il peut s'agir de multi-comptes (plusieurs comptes pour exploiter des essais gratuits ou des bonus d'inscription). La détection de bots, le fingerprinting et les signaux d'activité des comptes fonctionnent ensemble pour déclencher des actions correctives quand une activité automatisée ressemble à une activité frauduleuse.

Pourquoi vos outils d'analyse web ne détectent pas le trafic d'agents IA

Les crawlers et scrapers IA comme GPTBot et ClaudeBot n'exécutent pas du tout JavaScript. Ils récupèrent votre HTML, extraient le contenu et repartent. Votre snippet d'analyse ne se déclenche jamais, donc ces visites n'apparaissent jamais dans GA4, PostHog ou Amplitude.

Les agents IA basés sur navigateur ont le problème inverse. Ils opèrent dans de vrais navigateurs et génèrent des données de session qui ressemblent à celles d'un humain. GA4 et les autres outils d'analyse les comptent donc comme de vrais utilisateurs.

Que faire quand vous détectez du trafic d'agents IA

Ne bloquez pas par défaut

Il est tentant de bloquer tout ce qui semble automatisé, mais le blocage systématique vous nuit de deux façons. Vous perdez la visibilité sur ce qui se passe réellement sur votre site, et vous bloquez les agents grand public qui essaient d'acheter vos produits ou de recommander votre marque via la recherche IA.

Stratégies de réponse adaptatives au trafic d'agents IA

- Redirigez ou servez du contenu spécifique aux agents : Une compagnie d'assurance avec laquelle nous travaillons a découvert que des bots parcouraient leur workflow de devis pour extraire les tarifs. Leur solution : quand un bot était détecté dans le tunnel de devis, la dernière étape affichait un écran « contactez-nous » au lieu du devis généré. Aucune donnée tarifaire n'a fuité vers les concurrents/plateformes d'agrégation. En cas de faux positif, un humain pouvait quand même poursuivre le processus commercial.

- Personnalisez l'expérience. Au lieu de bloquer un agent, offrez-lui une vue dédiée. Une page qui indique « nous vous avons identifié comme un agent IA, voici une version optimisée » permet aux agents grand public d'obtenir les informations dont ils ont besoin tandis que vos visiteurs humains voient l'expérience complète.

Nous avons un guide complet qui couvre différents scénarios de fraude ici : Comment bloquer les agents IA frauduleux sur votre site web.

Comment cside résout la détection de bots IA et de navigateurs agentiques

cside est une plateforme de sécurité web spécialisée dans la surveillance de l'environnement d'exécution du navigateur. La détection d'agents IA de cside est spécifiquement conçue pour identifier les agents IA frauduleux sur votre site web. Avec cside :

- Obtenez un tableau de bord indiquant quels agents accèdent à votre site et ce qu'ils font

- Scores de risque automatiques basés sur les signaux comportementaux pour détecter les agents IA malveillants (y compris ceux basés sur navigateur et hébergés localement) qui échappent aux défenses anti-bots traditionnelles

- Intégrez les signaux de détection dans vos propres workflows d'actions correctives

- Prévenez la fraude par agents IA comme l'abus de codes promo, le piratage de contenu, le test de cartes de crédit, la découverte de vulnérabilités et le scraping avancé