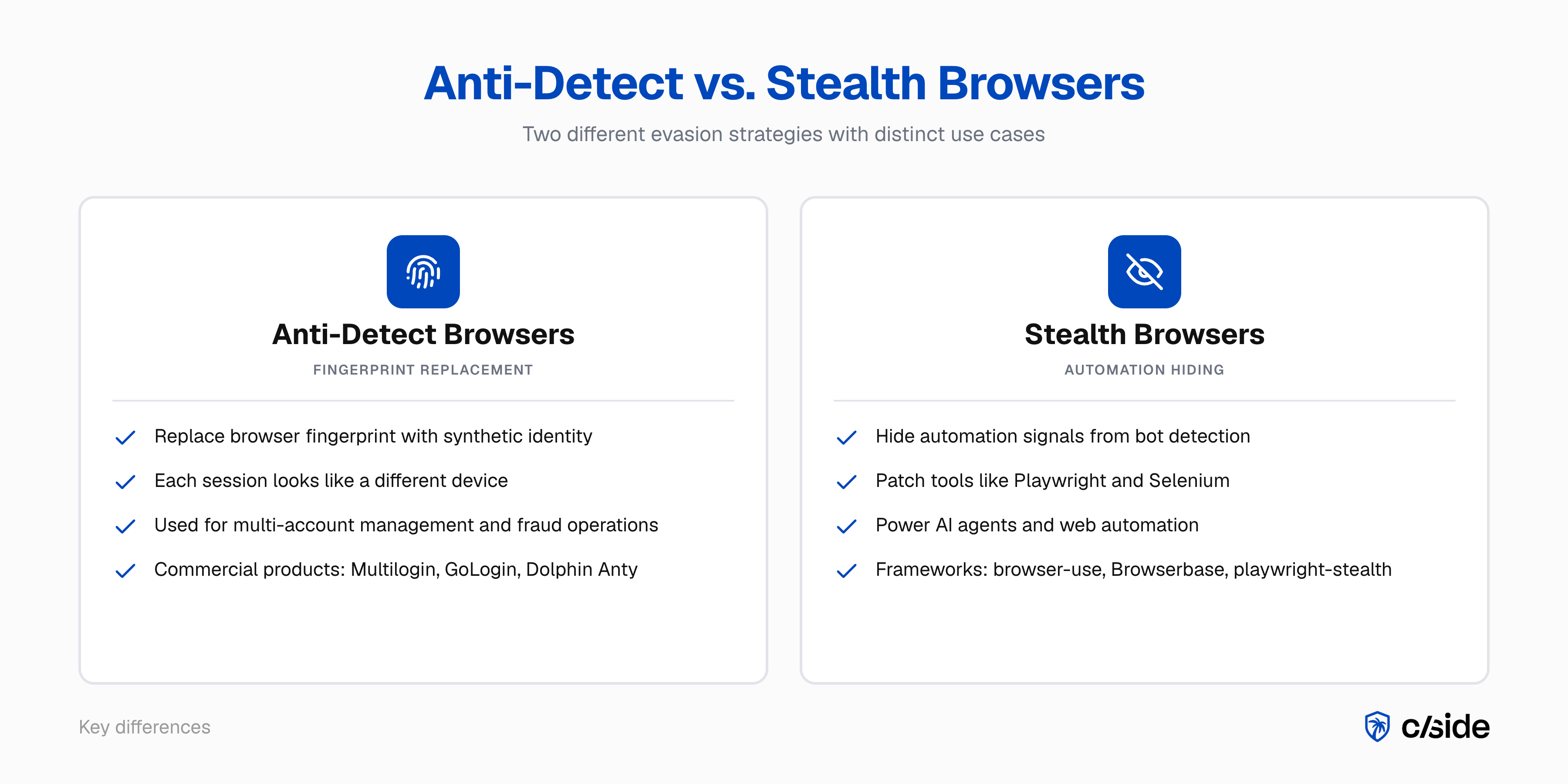

Dois termos continuam a aparecer nas conversas sobre deteção de bots e prevenção de fraude: "navegadores stealth" e "navegadores anti-detect". São usados de forma intercambiável, mas resolvem problemas diferentes, atraem utilizadores diferentes e exigem estratégias de deteção diferentes.

Navegadores anti-detect substituem a impressão digital do navegador por uma sintética para que pareça um dispositivo diferente em cada sessão. Navegadores stealth aplicam patches em ferramentas de automação para que os bots passem por utilizadores reais.

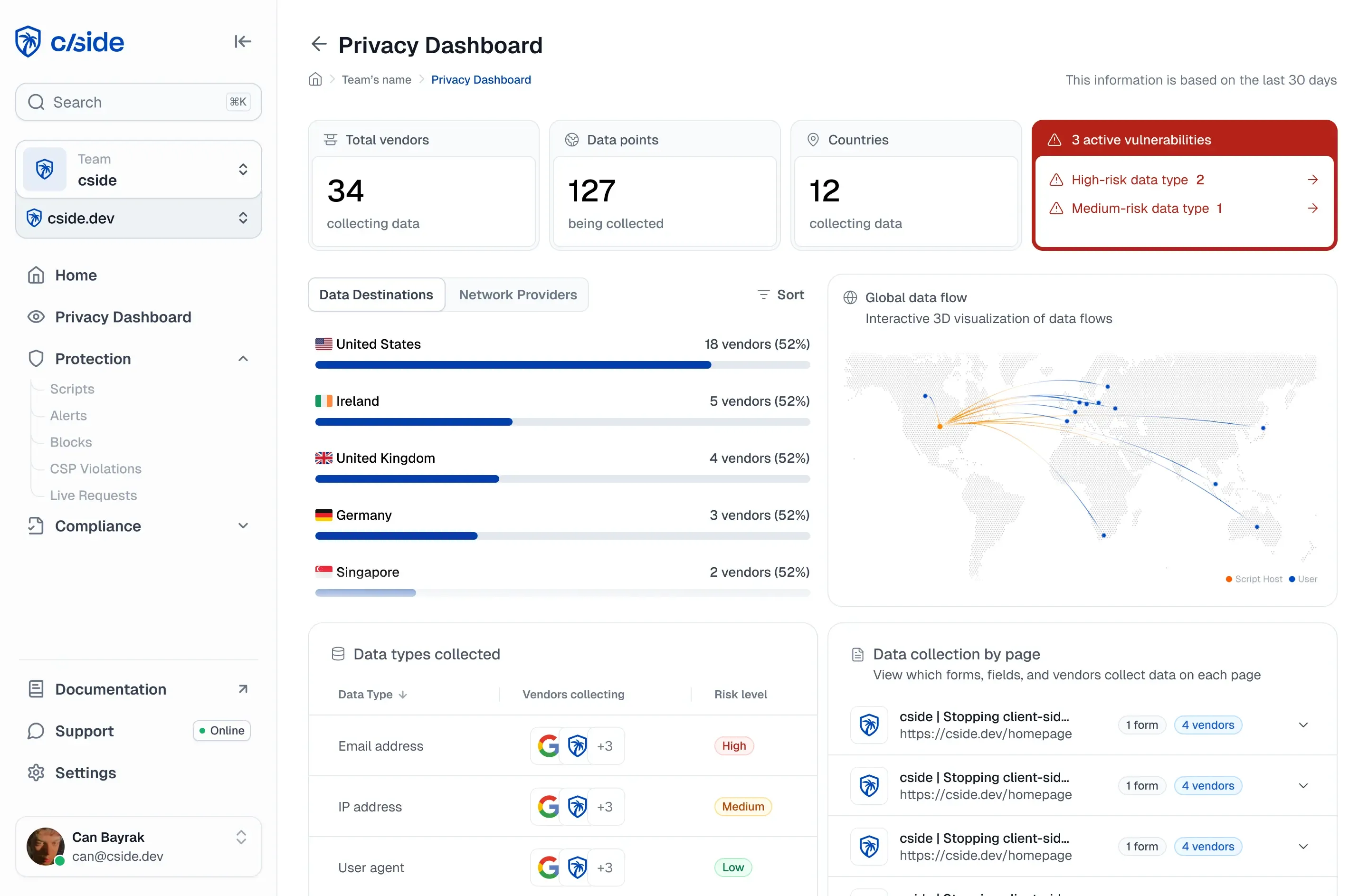

Ferramentas como a cside surgiram para resolver este problema. Os nossos testes internos revelaram que ferramentas de deteção tradicionais falharam agentes de IA em 81 de 100 tentativas controladas. Para empresas que querem travar fraude com agentes de IA (credential stuffing, scraping) ou fraude relacionada com contas (como criação de contas falsas, partilha de contas), a capacidade de detetar navegadores stealth é crucial. Isto é possível através de fingerprinting avançado e deteção de sinais comportamentais.

Qual é a diferença entre navegadores anti-detect e navegadores stealth?

Navegadores anti-detect

Um navegador anti-detect é um navegador modificado (geralmente um fork de Chromium ou Firefox) que substitui APIs que geram impressões digitais para que cada sessão apresente uma identidade sintética única. Produtos como Multilogin, GoLogin, Dolphin Anty e AdsPower são vendidos comercialmente com documentação, suporte ao cliente e funcionalidades de colaboração em equipa.

O termo existe desde aproximadamente 2015. É tipicamente usado para referir navegadores concebidos para evadir a deteção por fingerprinting.

Navegadores stealth

Um navegador stealth é uma configuração de automação de navegador construída sobre ferramentas como Playwright ou Selenium, ou frameworks de agentes de nível superior como browser-use e Browserbase, com bibliotecas de evasão especificamente concebidas para ultrapassar a deteção de bots. Resolvem CAPTCHAs através de modelos de visão por IA ou serviços de resolução humana, usam proxies residenciais e ajustam propriedades do navegador para permitir ações automatizadas num site sem serem bloqueados.

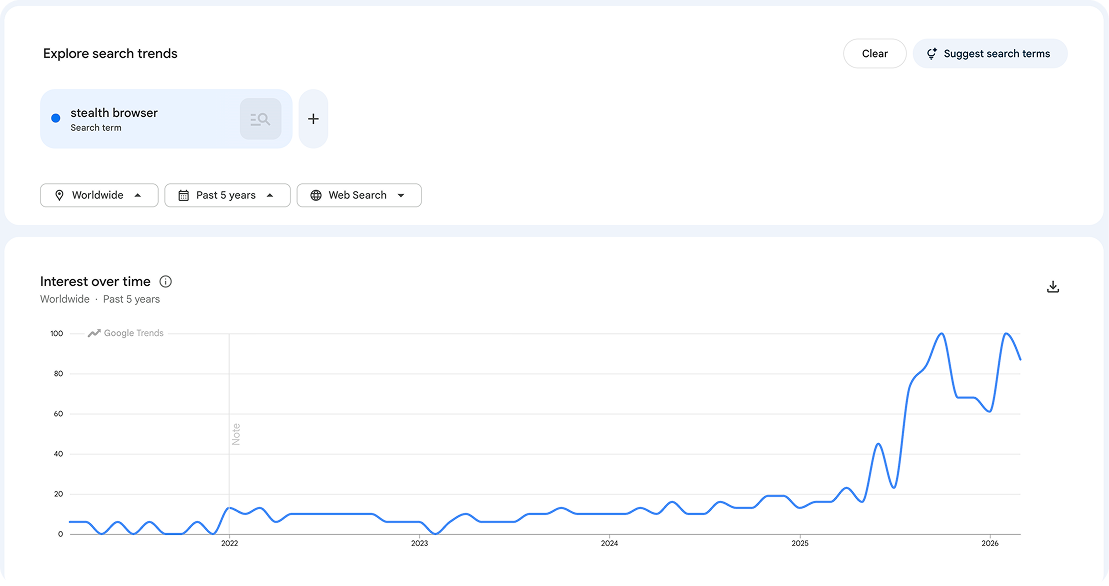

Este termo é relativamente novo, tendo crescido acentuadamente em 2025 com o aumento da automação por agentes. Quando um utilizador pede ao ChatGPT para navegar na web, ou um assistente de IA de programação consulta documentação em nome de alguém, a infraestrutura subjacente é um navegador stealth. O utilizador pode nem se aperceber. Para uma análise mais detalhada de como estes agentes evadem defesas tradicionais, consulte como os agentes OpenClaw contornam a deteção de bots.

Os sinais que usamos na cside para detetar navegadores stealth e anti-detect

A cside é uma plataforma de segurança web especializada na monitorização da camada de execução do navegador. Ajudamos organizações a prevenir fraude como web skimming, fraude de contas e fraude impulsionada por agentes de IA. Como organização, somos co-chairs da unidade de segurança anti-fraude do W3C.

Tanto a nossa solução de Fingerprinting como a de deteção de agentes de IA utilizam mais de 102 sinais para detetar navegadores stealth e anti-detect. Sendo um jogo do gato e do rato, as táticas de evasão mudam constantemente. Temos uma equipa dedicada a atualizar as técnicas de deteção para nos mantermos à frente.

| Abordagem de deteção | O que deteta | O que navegadores anti-detect/stealth derrotam |

|---|---|---|

| Reputação de IP | IPs de datacenter e IPs conhecidos como maliciosos | Proxies residenciais (histórico de IP limpo) |

| Filtragem de user-agent | User-agents de bots conhecidos | Strings de navegador sintéticas mas plausíveis |

| Blocklist de hashes de impressão digital | Impressões digitais conhecidas como maliciosas | Impressões digitais sintéticas novas sem histórico |

| Flags WebDriver / automação | Navegadores headless básicos | Patches stealth que normalizam as APIs do navegador |

| Limitação de taxa por sessão | Sessões únicas de alta velocidade | Velocidade distribuída por muitas identidades sintéticas |

| Deteção comportamental / camada do navegador | Padrões de interação, estado, temporização | Não pode ser totalmente suprimida por spoofing de impressão digital ou patches stealth |

-

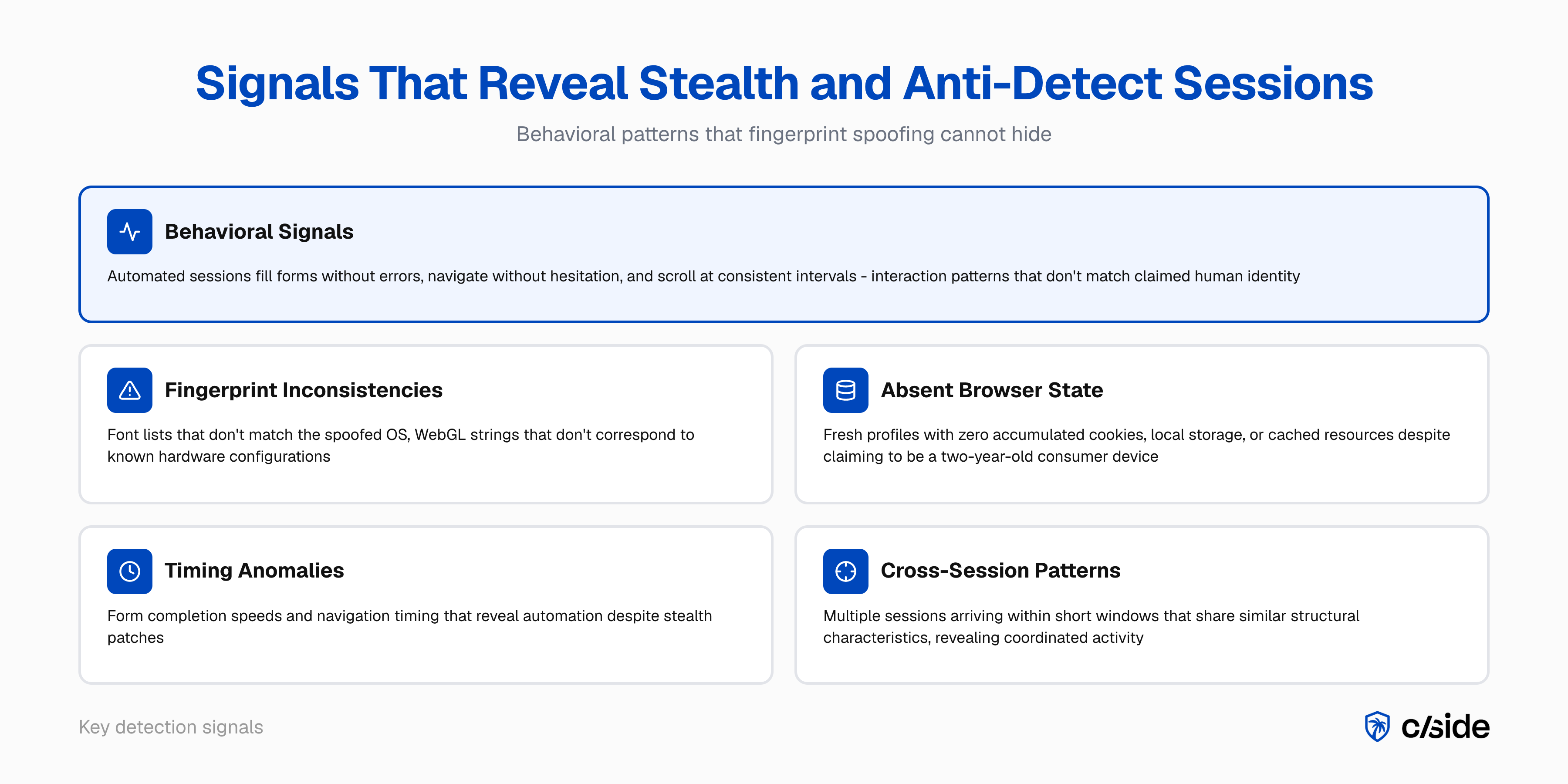

Inconsistências internas de impressão digital. Os perfis anti-detect variam em qualidade. Configurações de menor qualidade introduzem discrepâncias detetáveis: uma lista de fontes que não corresponde ao SO falsificado, uma string de renderer WebGL que não corresponde a nenhum hardware real para o dispositivo declarado, ou uma saída AudioContext estatisticamente implausível. A camada de fingerprinting da cside recolhe estes sinais passivamente e sinaliza inconsistências que verificações superficiais não detetam.

-

Sinais comportamentais. Utilizadores humanos interagem de forma imprecisa: os trajectos do rato desviam-se, as velocidades de scroll variam, o preenchimento de formulários inclui pausas e correções. Sessões automatizadas, quer através de navegadores anti-detect ou stealth, preenchem formulários sem erros, navegam sem hesitação e fazem scroll a intervalos consistentes. A cside observa esta camada comportamental dentro da sessão do navegador, onde nem o spoofing de impressões digitais nem os patches stealth conseguem suprimir o sinal.

-

Correlação entre sessões. Nenhuma sessão individual pode parecer anómala por si só. O padrão entre sessões sim. Múltiplas sessões que chegam dentro de uma janela temporal curta e partilham características estruturais semelhantes, temporização comportamental semelhante ou ações pós-sessão semelhantes revelam atividade coordenada que a análise de sessões individuais não deteta.

Quem usa navegadores stealth e anti-detect e porquê

Navegadores anti-detect

O principal caso de uso comercial é a gestão de múltiplas contas. Agências digitais que gerem várias contas publicitárias de clientes usam navegadores anti-detect para manter o isolamento de contas em plataformas que restringem o uso de múltiplas contas. Operadores de fraude usam as mesmas ferramentas para criação de contas falsas em escala, fraude de promoções e referências, testes de cartões, scraping coordenado e manipulação de avaliações. Cada sessão apresenta uma nova identidade sintética, tornando a deteção de duplicados por impressão digital ineficaz.

Navegadores stealth

Navegadores stealth alimentam a categoria de automação por agentes, em rápido crescimento. Os consumidores usam-nos, muitas vezes sem se aperceberem. Quando alguém pede a um assistente de IA para reservar um voo, comparar preços ou preencher um formulário, o agente de IA por trás desse pedido está tipicamente a executar um navegador headless ou stealth que precisa de contornar CAPTCHAs e a deteção de bots para completar a tarefa.

A Gartner prevê que até 2030, 20% das receitas das empresas, representando biliões de dólares globalmente, virão de clientes "máquina". Uma parte significativa desse comércio impulsionado por máquinas passará por infraestrutura de navegadores stealth. Os agentes não estão a tentar cometer fraude. Estão a executar tarefas que os utilizadores lhes pediram. Mas ainda precisam de ultrapassar a deteção de bots para funcionar, o que os coloca na mesma categoria técnica que a automação maliciosa na perspetiva de um sistema de deteção.

Uso comercial legítimo

Existe também uma categoria de uso de navegadores stealth que não é impulsionada por agentes mas ainda assim é legítima:

- Testes end-to-end de aplicações. Equipas de QA executam navegadores headless contra ambientes de staging e produção. Estas sessões precisam de se comportar como navegadores reais, e alguns frameworks de teste usam patches stealth para evitar serem bloqueados pela própria deteção de bots da aplicação.

- Plataformas de agregação de dados. Sites de comparação de preços, agregadores de viagens e plataformas de inteligência de mercado fazem scraping de dados em milhares de fontes. Se quer bloqueá-los depende do seu modelo de negócio, mas a intenção é comercial, não fraudulenta.

- Testes de acessibilidade e conformidade. Ferramentas automatizadas que auditam sites para conformidade WCAG ou requisitos regulamentares frequentemente executam através de navegadores headless.

Alguns sites preocupam-se em bloquear estes casos de uso. Outros não. O ponto é que o tráfego de navegadores stealth não é automaticamente malicioso, e a sua resposta de deteção deve ter isso em conta.

Como funcionam os navegadores anti-detect e stealth

Navegadores anti-detect

Navegadores anti-detect intercetam as APIs JavaScript do navegador ao nível do motor e substituem os valores reais do dispositivo por valores sintéticos. Quando uma página chama canvas.getContext('2d').getImageData(), o navegador anti-detect devolve um array de píxeis determinístico mas sintético em vez da saída real de renderização da GPU. O mesmo se aplica a WebGL, AudioContext, enumeração de fontes e propriedades do navigator.

| Vetor de impressão digital | O que um navegador normal expõe | O que navegadores anti-detect fazem |

|---|---|---|

| Canvas 2D | Artefacto real de renderização da GPU | Ruído sintético de píxeis, determinístico por perfil |

| Renderer WebGL | String real do fabricante + modelo da GPU | Falsificado a partir de uma biblioteca de strings de dispositivos reais |

| Fontes instaladas | Fontes reais do sistema | Lista filtrada que corresponde ao perfil de SO falsificado |

| Resolução de ecrã | Dimensões reais do ecrã | Valor sintético que corresponde ao tipo de dispositivo falsificado |

| Navigator.userAgent | Versão real do navegador + SO | UA sintético da configuração do perfil |

| Fuso horário / idioma | Configurações reais do sistema | Falsificado para corresponder a uma geografia alvo |

| Hardware concurrency | Contagem real de núcleos de CPU | Valor sintético consistente com o dispositivo falsificado |

| AudioContext | Impressão digital real do hardware de áudio | Saída sintética determinística |

Perfis bem construídos mantêm consistência interna: o user-agent falsificado corresponde ao tamanho de ecrã, plataforma e lista de fontes falsificados. É isto que os torna difíceis de sinalizar por sistemas baseados em impressões digitais apenas por inconsistência.

Navegadores stealth

Navegadores stealth resolvem um problema diferente. Em vez de falsificar uma identidade de dispositivo, escondem o facto de que o navegador é automatizado. Uma sessão padrão de Chrome headless expõe sinais reveladores: navigator.webdriver está definido como true, o objeto window.chrome está ausente ou incompleto, e certas propriedades JavaScript comportam-se de forma diferente do que numa sessão de utilizador real.

Patches stealth abordam estes sinais sistematicamente. Bibliotecas como playwright-stealth substituem navigator.webdriver, injetam um objeto window.chrome realista, corrigem o comportamento de permissions.query e normalizam navigator.plugins. Frameworks de nível superior como browser-use e Browserbase abstraem isto ainda mais, dando aos agentes de IA um ambiente de navegador pronto a usar com evasão incorporada. Configurações mais sofisticadas também tratam da prevenção de fugas WebRTC, consistência de fuso horário com a geolocalização do proxy e impressões digitais TLS realistas.

O desafio para a deteção é que o ecossistema de bibliotecas de evasão evolui continuamente à medida que novos sinais de deteção são identificados. Quando um fornecedor de deteção de bots sinaliza um novo sinal de automação, a comunidade de mantenedores de bibliotecas stealth responde com patches. É uma corrida armamentista persistente.

Por que a deteção padrão falha contra navegadores anti-detect e stealth

Navegadores anti-detect

A deteção padrão compara sessões com sinais de fraude conhecidos: intervalos de IP maliciosos, impressões digitais sinalizadas, user-agents suspeitos. Navegadores anti-detect substituem todos esses sinais por equivalentes sintéticos limpos.

- Bloqueio de IP falha porque navegadores anti-detect combinam-se com proxies residenciais. O IP pertence a um dispositivo de consumidor real sem histórico de fraude.

- Bloqueio por hash de impressão digital falha porque cada sessão gera um novo hash de impressão digital que nunca apareceu numa blocklist.

- Filtragem de user-agent falha porque o user-agent é uma versão de navegador plausível e real sem nada de anómalo.

Navegadores stealth

Sistemas de deteção de bots procuram sinais de automação: a flag webdriver, APIs de navegador ausentes, comportamento JavaScript inconsistente, artefactos de renderização headless. Navegadores stealth aplicam patches a todos estes.

- Deteção de WebDriver falha porque bibliotecas stealth substituem

navigator.webdriverpara devolverfalse. - Desafios CAPTCHA falham porque as sessões são resolvidas por modelos de visão por IA ou serviços de resolução humana de CAPTCHAs.

- Verificações de ambiente JavaScript falham porque patches stealth normalizam o ambiente do navegador para corresponder a uma sessão de utilizador real, incluindo

window.chrome,navigator.pluginse comportamento de permissões.

A cside descobriu que ferramentas de deteção tradicionais falharam agentes de IA em 81 de 100 tentativas controladas. O estudo FP-Inconsistent (Vekaria et al., ACM IMC 2025) concluiu que bots evasivos que utilizam manipulação de impressões digitais alcançaram uma taxa de evasão média de aproximadamente 53% contra serviços anti-bot comerciais. Sessões que utilizam navegadores anti-detect e stealth são uma razão central para essa lacuna: derrotam todas as camadas de deteção que operam com sinais de identidade em vez de sinais comportamentais.

Quando bloquear vs. desafiar sessões de navegadores anti-detect e stealth

A Forrester renomeou a categoria de gestão de bots para "Bot and Agent Trust Management Software" no Q4 de 2025, validando um modelo de resposta graduada em vez de decisões binárias de permitir/bloquear. O objetivo não é bloquear tudo o que parece diferente, mas aplicar a resposta certa ao nível de confiança certo.

| Confiança da sessão | Sinais presentes | Resposta recomendada |

|---|---|---|

| Alta (3+ sinais convergentes) | Inconsistência de impressão digital + estado limpo + precisão comportamental | Bloquear no registo ou checkout |

| Média (1-2 sinais) | Estado limpo + regularidade comportamental, sem inconsistência de impressão digital | Desafiar: autenticação reforçada, verificação de morada |

| Baixa (apenas comportamental) | Padrões de interação ligeiramente regulares, sem sinais de impressão digital | Limitar taxa de acesso ao catálogo; monitorizar para escalação |

| Agente (legítimo) | Navegador stealth com tarefa iniciada por humano, sem sinais de fraude | Permitir com monitorização; marcar segmento para revisão |

| Uso legítimo de múltiplas contas | Camada comportamental humana intacta, padrão de gestão de contas | Permitir com monitorização; marcar segmento para revisão |

Para fluxos de registo, bloquear sessões de alta confiança antes da criação da conta impede que infraestrutura de contas falsas seja estabelecida. Para o checkout, um desafio de autenticação reforçada é geralmente preferível: adiciona fricção sem cancelar uma transação real se a sessão for um falso positivo. Para páginas de catálogo e preços, limitar a taxa de sessões detetadas degrada o valor das operações de scraping sem bloquear utilizadores legítimos no mesmo segmento de tráfego.

A categoria mais difícil é o tráfego impulsionado por agentes. Uma sessão de navegador stealth a executar uma tarefa legítima de um utilizador (comparar preços, preencher um formulário) vai acionar os mesmos sinais de deteção que um bot malicioso. A diferença está no padrão comportamental e na ação pós-sessão. Sessões legítimas de agentes tendem a ser isoladas, orientadas a um objetivo e não repetitivas. A automação maliciosa tende a ser de alto volume, sistemática e repetitiva entre muitas identidades sintéticas.

Para um guia prático sobre como bloquear tráfego indesejado de agentes, consulte como bloquear agentes de IA no seu site.